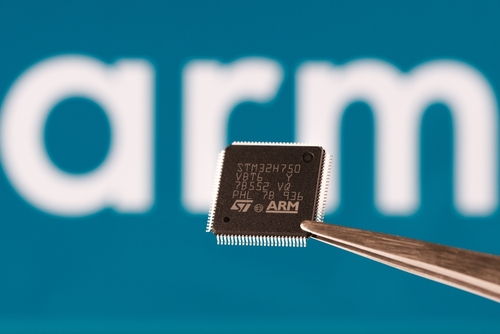

Arm社、Meta社を最初のデータセンター顧客として、3ナノメートルAGI CPUを発表

Armは、何十年も避けてきたことをついに実行に移した。これまで世界のチップの大部分を陰で支えてきた同社が、ついに表舞台に出て、自社製プロセッサを開発したのだ。設計図を販売してロイヤリティを徴収するだけでなく、Armは自社製シリコンを市場に投入し、まずはデータセンターをターゲットとした3ナノメートルAGI CPUを発売する。.

これにより、Armは、自社のアーキテクチャに基づいて製品を開発した企業の一部と直接競合することになる。.

最高経営責任者のレネ・ハース氏は火曜日、サンフランシスコで開催されたイベントで、自社開発の新プロセッサを発表した。同社はこのプロセッサをAGI CPUと呼び、AIワークロードを対象としたデータセンター向けチップだ。Armはもはや基盤となる技術だけを販売するのではなく、チップそのものを販売するようになった。.

MetaがArmに加わり、AIインフラを拡張

Meta社は最初の顧客となる。同社は数ギガワット規模のAIデータセンターを建設中で、今年の設備投資額は最大1350億ドルに達する見込みだ。.

Metaは2月にもNvidiaとAdvanced Micro Devicesから大量のチップ供給を確保していた。今回のArmとの契約により、AI構築の拡大に伴い、さらにプロセッサの供給元が一つ増えることになる。.

2023年からArmチッププロジェクトに携わってきたMetaのソフトウェアエンジニア、ポール・サーブ氏は記者団に対し、「今日の世界では、実際に活躍できる企業はほんの数社しかない」と語った。

ポール氏はまた、今回の契約によって「当社のソフトウェアスタックとサプライチェーンにおいて、より大きな柔軟性が得られる」と述べた。両社は契約条件を明らかにしていない。.

エージェント型AIの計算負荷が増加するにつれてCPU需要が上昇する

今回の発表は、AI分野でCPUへの注目が高まっている中で行われた。AIグラフィックスプロセッサ市場をリードするNvidiaは以前、エージェント型AIの登場によりコンピューティングニーズが変化するにつれ、CPUが「ボトルネックになりつつある」と述べていた。

フューチュラム・グループはこれを「静かな供給危機」と呼び、CPU市場の成長率が2028年までにGPUの成長率を上回る可能性があると予測した。.

この2種類のチップの区別は単純だ。GPUは数千個のコアが同時に多くの演算を実行できるため、AIモデルのトレーニングや実行に役立つ。.

CPUは、汎用タスクを順次実行するために設計された、少数のtronコアを扱っています。エージェント型AIは、膨大な量のデータが複数のエージェント間でやり取りされるため、こうした汎用的な計算処理能力を多く必要とします。.

先週開催されたNvidiaのGTCカンファレンスで、CEOのジェンセン・フアン氏はVera CPUのみを詰め込んだラックを披露した。火曜日に開催されたArmのイベントでは、フアン氏は録画された声明で同社の発売を祝福した。Google、Amazon、Microsoft、Oracle、Broadcom、Micron、Samsung、SK Hynix、Marvellのリーダーたちも出席した。Armは記者団に対し、発売前に約50社のパートナー企業が支持を表明していたと語った。.

ArmのクラウドAI責任者であるモハメド・アワド氏は、「これは1兆ドル規模の市場であり、我々が繰り返し目にしているのは、パートナー企業がこの市場を理解し、業界にとって素晴らしいものであると認識し始めていることだ」と述べた。

Armはテストを拡大し、TSMCに依存

この段階に到達するために、Armはテキサス州オースティンのキャンパスに3つの新しい実験室を建設するために7100万ドルと約18ヶ月を費やした。.

かつては小規模だったチームは、今では1000人以上にまで成長した。エンジニアたちはこれらの研究所を利用して、工場から出荷されたチップを取り出し、繰り返しテストを行っている。.

ほとんどのファブレスAIチップ企業と同様に、Armは台湾積体電路製造(TSMC)にプロセッサの製造を委託している。AGI CPUはTSMCの3ナノメートルプロセスで製造され、現時点ではすべての生産が台湾で行われている。.

TSMCはアリゾナ州に3nmプロセスの製造工場を準備している。アワド氏は、Armは「ここで製造したい」と述べたが、最終的な決定は顧客の要望次第だと付け加えた。.

Armは、ほぼすべてのスマートフォンに搭載されているモバイルチップの動力源として、依然として最もよく知られています。2018年にはNeoverseでデータセンター向けチップ市場に参入しました。AmazonはGravitonでこのプラットフォームを主流に押し上げ、GoogleとMicrosoftもArmの設計に基づいたAIチップを開発しています。.

ムーアヘッド氏は、「Armが存在しなければ、独自のプロセッサを持つ企業はどれも自社でプロセッサを開発できなかっただろう」と述べた。サーバー用チップのほとんどは依然としてIntelとAMDのx86設計を採用しており、ムーアヘッド氏はこれを「実績のある確かなもの」と評した。

アワド氏は、チームがAGI CPUを汎用人工知能向けに「徹底的に最適化」したため、その名前が付けられたと述べた。空冷式のラック1つには最大64個のCPU、つまり約8,700個のコアを搭載できる。彼は「x86ラックよりもワットあたりの性能が2倍になる」と語った。

ポール氏は、電力は「非常に希少な資源」だと述べ、ワットあたりの性能が向上すれば、データセンターの他の部分により多くの電力を供給できると付け加えた。.

最も賢い暗号通貨マインドを持つ人々はすでに私たちのニュースレターを読んでいます。参加してみませんか?ぜひご参加ください。

コメント (0)

$ボタンをクリックし、シンボルを入力して、株式、ETF、またはその他のティッカーシンボルをリンクします。