ジェンスン・ファン氏が謝意を表明。サムスンはエヌビディアGTCにおける最大の勝者となるか?

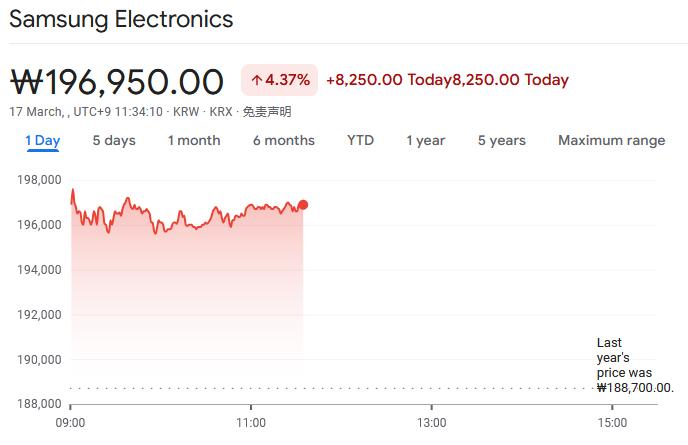

サムスン電子とNVIDIAの提携がLPX推論ラック発表で加速し、サムスンの韓国株価は4%超上昇した。NVIDIAはGroqのLPUチップ製造をサムスンに初発注し、LPXラック10万台導入でサムスンは100億ドルの増収が見込まれる。サムスンは次世代HBM4Eを初公開し、NVIDIAプラットフォームへの高性能メモリー提供を強化。データセンターやエッジデバイス向けソリューションも拡充し、AIコンピューティング分野で包括的な戦略を展開、AI市場拡大への貢献が期待される。

TradingKey - NVIDIA GTC 2026カンファレンスにおいて、サムスン電子とNVIDIA( NVDA)の緊密な提携が業界の注目の的となっている。

両社はチップ受託製造(ファウンドリ)分野で画期的な成果を上げただけでなく、メモリー技術やシステムアーキテクチャを含む多角的な側面で提携しており、AI推論時代における産業変革を共同で推進している。この提携を受け、発表後の火曜日の取引でサムスン電子の韓国株価は4%以上上昇した。

NVIDIA、LPXチップの製造でサムスン・ファウンドリを初採用

今回のカンファレンスで、NVIDIAはGroqの技術に基づいた推論用ラック「LPX」を正式に発表した。この製品は「分散型推論」アーキテクチャを採用しており、AI推論プロセスをプリフィル(Prefill)とトークン生成の2つのフェーズに分割し、それぞれをRubin GPUとGroqのLPUチップが担当する。

このうち、Groqの中核となるLP30チップはサムスン電子が製造しており、NVIDIAがTSMC( TSM )以外のメーカーにサーバー用チップの発注を行うのは今回が初めてとなる。

ジェンセン・ファンCEOは基調講演の中で、「Groq 3 LPUチップの生産に全力を尽くしてくれたサムスンに感謝する。彼らの生産能力拡大は予想を上回っている」と謝辞を述べ、ファウンドリ分野における両社の深い提携関係を公に認めた。

ハードウェア構成については、1台のLPXラックに256個のLP30チップを搭載可能で、1台のVera Rubin NVL72システムが1台のLPXラックに対応する(GPU対LPUの比率は72:256)。

市場需要の予測によると、世界中で10万台のLPXラックが導入された場合、サムスンのファウンドリ事業は約100億ドルの増収が見込まれる。TSMCが1個のRubin GPUの製造で得る1,000〜2,000ドルの収益と比較すると、LPXチップの製造および付随するHBMやDRAMの供給を通じてサムスンが得る総事業価値は、TSMCの3〜4倍に達する可能性がある。

HBM4E性能の飛躍的向上

同日、サムスン電子はGTCのブースで次世代の高帯域幅メモリー「HBM4E」の実物チップとコアウェハーを初公開し、AIストレージ分野におけるNVIDIAとの強力なシナジーを披露した。

サムスンのメモリー事業部長は、HBM4の量産で蓄積した第6世代10ナノメートル(nm)級DRAMプロセスと4nmベースダイ設計能力を活用し、HBM4Eの商用化を加速させると述べた。サンプル出荷は今年下半期に世界の顧客向けに開始される予定だ。

今回のカンファレンスで次世代HBM製品を公に展示したのはメモリーメーカーの中でサムスンのみであり、AIメモリー開発競争においてSKハイニックスやマイクロンといった競合他社との技術格差を広げる動きと見られている。

HBM4Eに加え、サムスンは「ハイブリッド銅ボンディング(HCB)」技術も発表した。従来の熱圧着ボンディング(TCB)と比較して、HCB技術は熱抵抗を20%低減し、16層以上のチップ積層をサポートできるため、次世代HBM製品の性能向上の基盤となる。

サムスンは、堅牢なAIシステムが産業革新を推進する鍵であると強調し、NVIDIAのVera Rubinプラットフォーム向けに高性能なメモリーソリューションを継続的に提供していく姿勢を示した。

ブース内には「NVIDIAギャラリー」を設置し、HBM4、サーバー向けメモリーモジュール「SOCAMM2」、SSD「PM1763」など、ストレージ分野における両社の提携成果を重点的に展示した。

このうち、SOCAMM2は業界初の量産型低消費電力サーバー用メモリーモジュールで、高帯域幅と柔軟なシステム統合機能を兼ね備えている。また、PM1763 SSDはPCIe 6.0インターフェースを採用し、AIアプリケーションに高速データ転送と大容量ストレージを提供する。

サムスンの「全シナリオ対応」AIコンピューティング戦略

併せて、サムスンはエッジデバイスからデータセンターに至るまで、AIコンピューティング分野における包括的な展開を披露した。

個人向けデバイスに関しては、NVIDIA DGX Spark向けのNAND製品「PM9E3」および「PM9E1」に加え、ハイエンドスマートフォンやタブレット向けのLPDDR5XおよびLPDDR6 DRAMソリューションを展示した。特にLPDDR6は、ピンあたりの帯域幅を30〜35Gbpsに拡大し、適応型電圧スケーリングや動的リフレッシュ制御を導入することで、次世代オンデバイスAIの処理能力を支える。

データセンター分野では、NVIDIA Vera Rubinプラットフォームの高速ストレージ基盤のリファレンス・アーキテクチャの一部として、サムスンの「PM1753」SSDが推論処理のエネルギー効率とシステム性能を向上させることが示された。

さらに、サムスンはAIファクトリー開発におけるNVIDIAとの提携成果を披露した。両社はNVIDIAの高速コンピューティング技術を導入してサムスンのAIファクトリーを拡張し、NVIDIA Omniverseライブラリに基づく製造業のデジタルツイン実装を加速させる計画だ。

AI市場の急速な拡大に伴い、サムスンとNVIDIAの深い提携関係は、持続的な事業成長と技術革新への原動力となると期待されている。

このコンテンツはAIを使用して翻訳され、明確さを確認しました。情報提供のみを目的としています。