Google TurboQuant圧縮アルゴリズムとは何か?AIストレージ半導体業界にどのような影響を与えるのか?

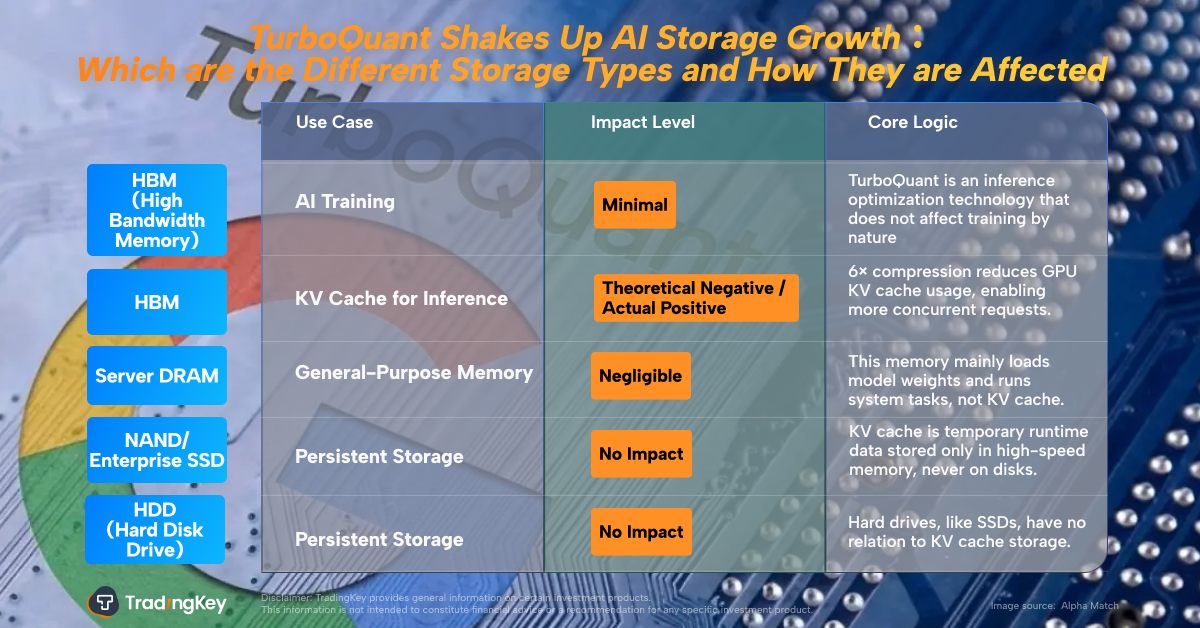

GoogleのAIメモリチップ業界への影響は、ベクトル圧縮アルゴリズム「TurboQuant」の導入により波紋を広げている。TurboQuantはKVキャッシュによるメモリ消費を約6分の1に圧縮し、推論効率を最大8倍向上させる。精度損失ゼロで事前学習も不要なため、多様なモデルに適用可能である。これにより、AIサーバーのHBM需要は維持・拡大し、DRAM需要には鈍化懸念が生じる。ただし、ジェボンズのパラドックスにより、AIアプリケーションの総メモリ需要は爆発的に増加する可能性があり、ストレージ業界への長期的な影響は不透明である。

TradingKey - Google ( GOOGL) ( GOOG ) によるベクトル圧縮アルゴリズム「TurboQuant」の導入は、的確に投じられた一石のように、AIメモリチップ業界全体に波紋を広げている。

この新しいベクトル圧縮アルゴリズムは、AI推論フェーズにおけるメモリ使用効率に向けて特別に最適化されており、特に高いキー・バリュー・キャッシュ(KVキャッシュ)占有率の課題解決に優れている。これは、AIモデルがより少ないメモリ消費でより多くのデータを処理できることを意味する一方で、業界に新たな課題も提示している。

では、TurboQuantとは具体的に何なのか。どのような独自の技術的優位性を備え、AIメモリ業界にどのような影響を及ぼすのだろうか。

TurboQuantとは何か?

TurboQuantは、2026年3月にGoogle Researchが正式に発表した新しいベクトル圧縮アルゴリズムである。大規模言語モデル(LLM)やベクトル検索エンジンの推論フェーズにおける核心的な課題、すなわちKey-Valueキャッシュ(KV Cache)による過度なメモリ消費の解決を目的としている。技術的な詳細は、4月23日から27日に開催されるICLR 2026(学習表現に関する国際会議)にて、査読付きの学術論文として正式に発表される予定だ。

大規模言語モデルの推論プロセスにおいて、KV Cacheはモデルの「一時的なノート」として機能する。ここでは、一連の対話や入力テキストの各セグメントが高次元ベクトルに変換され、後続の推論ステップにコンテキストを提供するために一時的に保存される。推論精度を確保するため、従来のソリューションでは通常、ベクトルデータを16ビット浮動小数点(FP16/BF16)形式で保存してきた。しかし、対話の長さやテキスト規模が拡大するにつれ、KV Cacheは「データのブラックホール」のごとくGPUの広帯域メモリを消費する。これは推論速度を低下させるだけでなく、計算コストを大幅に押し上げ、大規模モデル導入の主要なボトルネックとなっている。

業界のコンセンサスによれば、現在の大規模モデルのボトルネックはパラメータ数ではなく、メモリ容量にある。コンテキストが長くなるほどKV Cacheのメモリ占有領域は拡大し、最終的にはモデルパラメータよりも先にハードウェアの限界に達する。これは、長文生成や長大なドキュメントの理解といったタスクにおける共通の課題となっている。

TurboQuantの画期的な手法は、この課題を直接的に解決するものだ。

TurboQuantは2つの基盤技術の相乗効果により、追加のメモリオーバーヘッドをゼロに抑え、推論精度への影響もほとんどなしに、KV Cacheの極限までの圧縮を実現している。

第一のステップでは「PolarQuant」を用いて一次圧縮を行う。これはAIモデルのベクトルの従来の直交座標(XYZ)によるエンコーディング論理を打破し、極座標へと変換するものである。例えば、従来のエンコーディングが「東に3ブロック、北に4ブロック進む」という表現であるのに対し、極座標では「37度の角度で5ブロック進む」と記述する。これにより、ベクトルを「半径(コアデータの強度)+方向(データの意味論)」へと簡素化する。この変換によってベクトルは境界が固定された「円形グリッド」上にマッピングされ、従来の手法で必要だった高コストなデータ正規化の工程が不要となる。結果として、根本からストレージの冗長性を排除し、メモリ削減の大部分を達成する。

第二のステップでは、「QJL(Quantized Johnson-Lindenstrauss)」技術を利用して残留誤差を処理する。PolarQuantは効率的な圧縮を実現する一方で、わずかな精度の乖離が生じる可能性がある。QJLはわずか1ビットの計算能力を用いて各ベクトルに+1または-1の補正マーカーを付与し、「数学的な誤差修正マシン」として機能することで、ベクトル間の関係性を完全に維持しながらこれらの誤差を平滑化する。これにより、ニューラルネットワークがデータの重要度を判断する中核プロセスである「アテンション・スコア」をモデルが正確に算出できるようになり、修正フェーズ全体でのメモリオーバーヘッドもゼロに抑えられている。

TurboQuant、パフォーマンス指標で首位に立つ

グーグルの「TurboQuant」は、32ビットまたは16ビットのベクトルデータを約3ビットに圧縮するという、画期的な圧縮・効率性能を達成した。最大6倍という高い圧縮率により、大規模モデルのKVキャッシュのメモリ占有量を元の6分の1に直接削減することが可能となる。

ハードウェアのベンチマークにおいて、同アルゴリズムはNVIDIA H100などのデバイスで顕著な速度面での優位性を示し、計算効率は最大8倍まで向上した。

特筆すべきは、全工程において「精度損失ゼロ」を実現するために、事前学習やファインチューニングを一切必要としない点である。質疑応答、コード生成、長文要約といったタスク全般にわたって、性能はほぼ維持される。また、特定のデータセットに対するパラメータ調整も不要なため、様々な大規模モデルの推論シナリオに直接適用することが可能だ。

ベクトル検索のテストにおいても、TurboQuantは従来の積量子化手法を凌駕する結果を残した。再現率を維持しつつ、インデックス作成時間をほぼゼロに短縮できることは、セマンティックベクトルマッチングに依存する現代の検索エンジンにとって極めて重要である。現在、主流の検索エンジンは精密な意味検索のために数十億個の高次元ベクトルを使用しているが、TurboQuantの高い圧縮率は、ストレージコストを直接削減すると同時にレスポンス速度を向上させ、大規模な意味検索に新たな最適化の余地をもたらす。

実装の観点からは、TurboQuantはAIモデルの運用コストとメモリ要件を直接的に引き下げ、スマートフォンなどのハードウェア制約があるモバイル端末上でも、より高品質なローカル出力を可能にする。さらに、解放されたメモリ空間によって、より複雑なモデルの動作が可能になることから、将来的には「コスト削減とモデルの高度化」を同時に実現する実装トレンドが主流になると予想される。

TurboQuantがメモリチップに及ぼす影響

現在のAIハードウェア市場は「高価格・供給不足」という極めて困難な状況に陥っており、広帯域・大容量のストレージ資源がAIの大規模実装を制約する核心的なボトルネックとなっている。大規模モデルの学習および推論における超広帯域需要を満たすため、AIサーバーはHBM(高帯域幅メモリ)への強い依存を強めており、これが市場価格を直接押し上げ、世界的な供給不足が長期化する要因となっている。

大規模モデルの運用を支えるため、企業は「ハードウェアの積み増し」という力技の手法を余儀なくされており、AIの導入・運用コストは極めて高い水準に留まっている。しかし、GoogleのTurboQuant技術の登場により、各種メモリチップの需要ロジックが再構築される可能性がある。

サーバー用DRAM(DDR5)

TurboQuantの最適化対象は、AI推論シナリオにおいて最もメモリを消費するコンポーネントであるKVキャッシュおよびベクトルインデックス・モジュールに絞られている。同技術が大規模に導入されれば、単一のサーバーで「より少ないメモリでより多くのモデルをホストする」ことが可能になる。これにより、DRAM容量の需要伸び率が鈍化するとの懸念が市場で浮上しており、これが直近の市場センチメントの変化の直接的な要因となっている。

それでもなお、実際の需給環境による下支えは強力である。TrendForceの2026年第1四半期向け業界レポートによると、需給ギャップが拡大し続ける中、標準型DRAMの契約価格は前四半期比で55%-60%上昇すると予想されている。

HBM(高帯域幅メモリ)

AI学習シナリオの核心的なストレージ媒体であるHBMは、TurboQuantの影響を実質的に受けない。これは、TurboQuantが本質的に推論最適化技術であり、設計段階から学習用のメモリロジックには関与していないためである。AI学習におけるHBMの広帯域・大容量への需要は引き続き上昇しており、タイトな需給状況に変わりはない。

推論シナリオにおいて、HBMはむしろTurboQuantから追加的な恩恵を受ける立場にある。6倍の圧縮率により、GPUあたりのKVキャッシュ占有率が大幅に低下し、1台のGPUが処理できる同時リクエスト数が実質的に増加する。これまでKVキャッシュ容量によって制限されていたHBMの帯域幅の優位性が、より十分に発揮されるようになる。その結果、実際の推論効率が向上することで、ハイエンドAIサーバーにおけるHBMの導入価値はさらに高まるだろう。

NANDフラッシュ(エンタープライズ向けSSD)

TurboQuantがNANDフラッシュに与える影響のロジックは限定的である。これまでのNANDに対する市場の楽観的な期待は、AIサーバー向けストレージ需要の爆発的な増加という判断に基づいており、サムスンは今年1月の時点でNANDフラッシュの契約価格を100%以上引き上げていた。

しかし、TurboQuantは推論時のKVキャッシュ圧縮のみを対象としているため、モデルの保存や展開に必要とされるNANDフラッシュへの影響は非常に間接的かつ遅行的なものに留まる。

TrendForceの予測によると、2026年にはエンタープライズ向けSSDがNANDフラッシュの最大の用途セグメントとなり、クライアント向けSSDの契約価格は、全NAND製品カテゴリーの中で最大の上げ幅となる少なくとも40%の上昇が見込まれている。

HDD(ハードディスク・ドライブ)

ハードディスク・ドライブも永続的なストレージ媒体であり、KVキャッシュの動作ロジックとは全く無関係である。TurboQuantの推論最適化技術がその需要に与える影響は皆無である。

現在のHDD需要は、主にコールドデータストレージやアーカイブなどのシナリオに起因している。これらの要件はAI推論効率の向上とは無関係であり、長期的な需要ロジックは安定している。

TurboQuantがAIストレージ業界に与える影響とは。

GoogleのTurboQuant技術の発表を受けて、Micron Technology( MU )、Western Digital( WDC )、SanDisk( SNDK)などのメモリチップ関連株は一時的に下落したが、このパニック売りは本質的に、AI業界における需要ロジックに対する市場の誤認である。それは「AI推論の総同時需要は固定されている」という前提に立ち、単一カードの容量を増やせばハードウェアの総需要が減少すると想定しているが、この前提はAI業界においては全く通用しない。

テクノロジー業界の歴史的パターンが長年証明してきたように、リソース効率の向上によって総需要が減少することはない。むしろ、使用コストを急落させることで、以前は経済的に存立し得なかった膨大な数の新しいシナリオを触媒し、最終的に総需要の指数関数的な成長を牽引するのである。

例えば、太陽電池の変換効率が向上するにつれてキロワット時あたりのコストが低下し、世界の太陽光発電導入量は10年間で数十倍に急増した。同様に、4Gネットワークの帯域幅アップグレードとデータ価格の下落により、ショートビデオやライブストリーミングのトラフィック需要は100倍以上に爆発した。これと同じロジックがTurboQuantにも当てはまる。

第一に、推論コストの大幅な低下はAI総需要の爆発を直接誘発し、メモリ使用総量の急増を牽引する。TurboQuantはAI推論の限界コストを大幅に削減し、中小企業向けのインテリジェントなカスタマーサービス、実店舗でのAIショッピングガイド、産業機器のローカルAI品質検査、スマートフォンや自動車向けのオンデバイス大規模言語モデルなど、これまで高コストゆえに実現不可能だったシナリオを商業的に実行可能にする。

そうなれば、同時推論の量は指数関数的な成長を遂げるだろう。たとえカードあたりの容量が増えたとしても、必要なGPUの総数とそれを支えるストレージの規模は、以前よりも拡大する一方である。

同時に、スループットの向上は実際にはハイエンドストレージへの要求を高め、業界のリーダーに利益をもたらす。TurboQuantは単一カードの推論スループットを8倍に向上させるが、これはGPUとメモリ間の単位時間あたりのデータ読み書き量が直接8倍に増加したことを意味する。これはメモリの帯域幅、遅延、安定性に対してより高い要件を課すものであり、通常のDDR4では対応しきれない。これにより、DDR4からDDR5への移行が直接加速されるとともに、AIサーバーにおけるHBMの普及が促進され、最終的にはハイエンド・高帯域幅ストレージに位置する主要メーカーが恩恵を受けることになる。

長期的には、TurboQuantはストレージ需要の構造を変化させるだけであり、総需要が爆発的に増加するというマクロなトレンドを揺るがすことはない。

AIサーバー向けのストレージ需要は従来のサーバーの8倍から10倍に達する。世界のAI大規模モデルがトレーニング段階から大規模な応用段階へと移行するにつれ、メモリチップの需要は幾何級数的に増加しており、ストレージ業界の需要成長の核となるエンジンとなっている。

一方、メモリチップの需給逼迫は続いており、複数の有力機関が不足状態が持続すると予測している。野村證券は、2026年第2四半期のDRAMおよびNAND型フラッシュメモリの価格上昇予測を大幅に引き上げ、「桁違い」の跳ね上がりを予想している。

AI主導のストレージ需要拡大は不可逆的であるとのコンセンサスが業界内で形成されている。この強固な成長は少なくとも3年から5年は続くと予想され、業界チェーンのボトルネックは徐々にGPUからストレージ、パッケージング、ネットワーク帯域へと移っている。

たとえこの技術が今後1〜2年で大規模に商用化されたとしても、せいぜい推論側のカードあたりのメモリ構成構造を微調整するにとどまるだろう。「AIサーバー普及率の継続的な向上と、AIストレージ総需要の爆発的な増加」という核心的なロジックが変わることはなく、むしろこの傾向を加速させる触媒となる可能性さえある。

TurboQuantはどのような課題に直面しているのか。

TurboQuantはメモリ圧縮と推論効率において画期的な優位性を示しているが、技術的な実装から産業界への適応に至るまで、依然として複数の現実的な課題や潜在的な開発上のパラドックスに直面しており、決して無欠ではない。

圧縮精度とモデル性能のバランスは、避けて通れない核心的な課題である。現在、3ビットが圧縮率と性能の最適な均衡点であることが検証されている。しかし、極限の圧縮を追求して強引に2ビットまで下げれば、モデルのTop-1精度は66%まで急落し、明らかな論理的逸脱や的外れなAI出力が生じることになる。基幹タスクの性能低下は、圧縮による効率向上のメリットを直接相殺してしまう。つまり、TurboQuantの圧縮能力は無限に拡張可能ではなく、メモリ節約と出力品質の間の精密な適応範囲を見出す必要がある。

TurboQuantが現在謳っている「最大8倍の加速」は、NVIDIA H100などの最上位GPUアーキテクチャでしかフルに実現できない。これらのハードウェアは現在高価格で供給不足にあり、一方で消費者向けPC、モバイル端末、中低位サーバー向けの最適化にはより長いサイクルを要する。短期的には、ハードウェアの障壁が急速な普及の大きな足かせとなり、この技術の効率的な恩恵がすべてのAI推論シナリオに行き渡ることを阻んでいる。

一方で、TurboQuantがAI推論メモリを従来の6分の1まで圧縮できるようになったことで、クラウドプロバイダーやデータセンターはハイエンドメモリの調達予測を大幅に引き下げた。メモリメーカーの成長が鈍化するとの市場懸念から、Micronなどのストレージチップ大手の株価は短期間で激しく乱高下した。こうした感情的な反応はやや過剰な面もあるが、新技術の採用初期段階における既存の産業需給ダイナミクスへの衝撃を反映している。

最も注目すべきは、潜在的な「ジェボンズのパラドックス(Jevons Paradox)」効果である。

TurboQuantは個々のモデルのメモリ負荷と推論コストを軽減し、一見するとメモリ需要を減らすように見える。しかし、AIアプリケーションの限界コストが大幅に低下するにつれ、開発者はより複雑なモデルを開発し、より大規模なデータセットを取り込み、より多くのシナリオでAIを展開する傾向がある。これは最終的に世界の総メモリ需要の爆発を引き起こす可能性があり、いわゆる「メモリ負荷の緩和」が、むしろ需要拡大の触媒となるかもしれない。このパラドックスにより、ストレージ業界に対するTurboQuantの長期的な影響は極めて不透明なものとなっている。

コメント (0)

$ボタンをクリックし、シンボルを入力して、株式、ETF、またはその他のティッカーシンボルをリンクします。