Anthropic:那把插进英伟达 CUDA 心脏的利刃

2026年AI产业已从基础设施建设期迈入工业化收割期,核心在于垂直模型商与云巨头优化底层架构,实现利润回流。Anthropic凭借其创始人风险管理基因和金融级合规底色,以“宪法AI”在关键行业获得高客户续约率,成为避险资产。OpenAI ARR已超250亿美元,但研发支出高企。Anthropic商业模式类似成熟工业软件,客户粘性强,带来“合规溢价”。云巨头通过自研芯片适配Anthropic等模型,显著降低推理成本,利润回流率大幅提升,实现“去英伟达化”。英伟达面临战略挤压,市场重心从硬件转向拥有核心数据和自研芯片闭环的云平台巨头。投资者应关注资本支出的质量,审慎对待硬件环节,关注实现“成本下行、利润上行”的云平台巨头。

在2026年上半年,全球资本市场正处于一场深刻的范式转移之中。尽管纳斯达克市场在经历了2023至2025年的非理性繁荣后,正面临由大科技公司巨额资本开支(CapEx)引发的估值修复压力,但穿透市场的短期焦虑可以发现,AI产业已正式从“基础设施建设期”跨入“工业化收割期”。这场变革的核心逻辑不再是算力的盲目堆砌,而是以 Anthropic 为代表的垂直模型商与云巨头联手,通过底层架构优化,实现对“英伟达税”的财务清算与利润回流。

确定性溢价:Anthropic的B2B护城河与避险逻辑

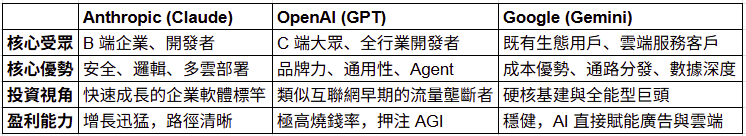

在AI投资的下半场,市场对模型的评价标准已从单纯的参数规模转向商业确定性。Anthropic 能够在 OpenAI 的先发优势下异军突起,本质上源于其创始人团队自带的“风险管理”基因。创始人 Dario Amodei 作为普林斯顿生物物理学博士及 OpenAI 前研究副总裁,是“规模定律”(Scaling Laws)的核心奠基人之一,这使其对模型训练的算力边际效用有着超越行业的精准把控。相比于单纯追求 AGI 愿景,Dario 更倾向于在算力红利期寻找成本与智力的最优平衡点,这为 Anthropic 在 2026 年实现极高的推理效率奠定了技术基础。

与其兄长不同,联合创始人 Daniela Amodei 在支付巨头 Stripe 积累的风险控制经验,为 Anthropic 注入了金融级的合规底色。在 2026 年复杂的监管环境下,Fortune 500 强企业对于 AI 助手的需求已不再是“博学”,而是“不可违约”。Anthropic 核心技术“宪法 AI”(Constitutional AI)通过内置价值观框架,实现了模型行为的自我克制。这种基于逻辑层面的安全机制,使得 Anthropic 在银行、药企及半导体设计等容错率为零的行业中,获得了极高的品牌忠诚度。截至 2026 年初,其企业级客户的净金额续约率(DBNRR)始终维持在 150% 以上,这种高确定性的 ARR(年度经常性收入)增长,使其成为了大科技公司眼中最昂贵的“避险资产”。

营收成色拆解:OpenAI的规模效应与Anthropic的工业垂直度

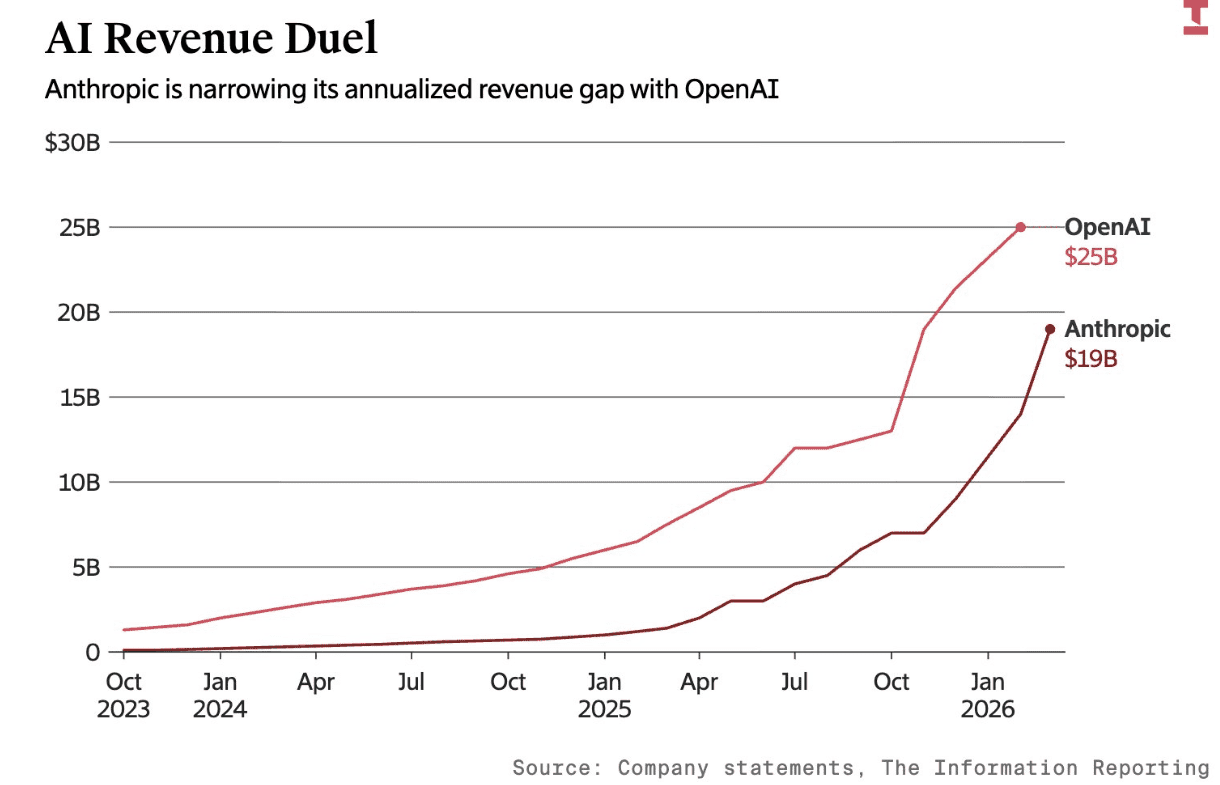

2026 年的财务数据显示,顶级 AI 模型商已具备极强的造血能力。根据高盛与摩根士丹利的联合调研,OpenAI 在 2026 年的预计 ARR 已突破 250 亿美元大关。在完成 500 亿美元的新一轮融资后,OpenAI 通过亚马逊的AWS与微软的Azure的双向分发策略,成功实现了从 C 端大众到全行业开发者的全量覆盖。然而,在营收规模的背后,OpenAI 仍面临着极高的研发与算力支出,其估值逻辑依然带有浓厚的“流量垄断”色彩。

相比之下,Anthropic 的商业模型更接近于成熟的工业软件。其客户群体并非随机的互联网用户,而是深耕于生产线自动化的专业机构。在 2026 年,药企利用 Claude 的逻辑推理能力缩短了 30% 以上的临床实验分析周期,半导体设计公司则通过其“计算机操作代理”(Computer Use)功能实现了 EDA 工具的自动化运行。对于这些客户而言,Claude 不是对话框,而是嵌入生产流程的精密插件。这种深度的业务绑定意味着,尽管其 Token 表面单价略高,但其带来的合规成本下降与研发增效,构成了企业愿意长期买单的“合规溢价”。与此同时,虽然 Meta 的 Llama 系列在开源领域持续施压,但在 B2B 领域,开源模型缺乏的法律背书与 SLA(服务等级协议)保障,依然无法动摇 Anthropic 的商业壁垒。

权力链路重构:自研芯片与“去英伟达化”的财务闭环

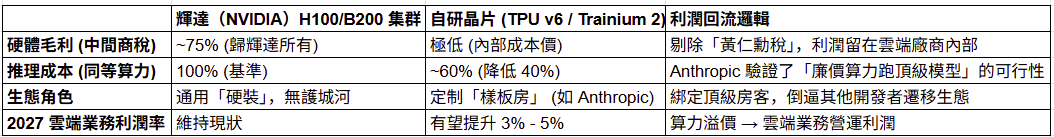

当前市场对大科技资本开支的恐慌,很大程度上忽略了“房东、房客与物业费”的闭环逻辑。2023 至 2024 年,云巨头(房东)建设数据中心几乎完全依赖英伟达的 GPU,导致其毛利被高额的硬件采购成本蚕食。然而到了 2026 年,这一局面已发生根本性逆转。亚马逊的 Trainium 2/3 以及谷歌的 TPU v6/v7 已通过 Anthropic 等顶级模型(房客)的深度适配,完成了从实验产品到工业级基建的跃迁。

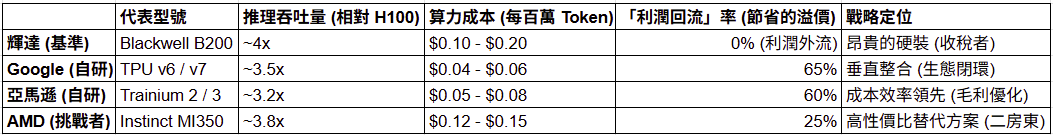

财务闭环的关键在于“利润回流率”。英伟达的 Blackwell B200 芯片虽然在吞吐量上依然领先,但其每百万 Token 的推理成本仍维持在 0.10 至 0.20 美元之间,且对于云巨头而言,这部分支出属于纯粹的“利润外流”。反观谷歌的自研 TPU,通过与 Anthropic 的原生适配,推理成本已降至 0.04 至 0.06 美元,利润回流率高达 65%。这种成本端的降维打击意味着,云巨头通过扶持 Anthropic,成功实现了对英伟达 CUDA 生态的解耦。按照摩根士丹利的测算,随着 30% 以上的推理负载转向自研芯片,顶级云服务商的运营利润率在 2027 年前有望提升 3% 至 5%。这种由于技术自主权回归带来的毛利扩张,正是 CapEx 支出转化为长期盈利能力的直接证据。

英伟达估值的黄昏:从绝对垄断到红海竞争

在 2026 年这个“推理元年”,英伟达正面临着前所未有的战略挤压。在 AI 发展的早期阶段,训练算力的稀缺性确立了英伟达的霸权;但在推理阶段,性价比、功耗以及与云端的原生集成度成为了核心竞争要素。随着 Anthropic 证明了在非英伟达芯片上同样能跑出顶级逻辑,英伟达的 CUDA 防线已出现裂缝。

从估值模型来看,英伟达目前的市盈率要求其维持 75% 以上的毛利与绝对的垄断地位。然而,当亚马逊、谷歌等万亿巨头联手通过扶持 Anthropic 来实现供应链自给自足时,英伟达正从“唯一的算力心脏”跌落为“高价的通用备胎”。市场正在重新审视硬件耗材商的周期性风险,而资金则倾向于回流到那些拥有核心数据、分发渠道以及自研芯片闭环的云平台巨头手中。Alpha(超额收益)的阵地已从底层的硬件端彻底转移到了生产力工具的掌控者手中。

结论:理性投资者的“收成期”策略

综上所述,2026 年的市场调整并非 AI 泡沫的破裂,而是产业权力的重新分配。投资者应摒弃对 CapEx 总额的盲目恐惧,转而关注资本支出的“质量”——即这些投入是否有效地转化为对自研芯片的适配以及对 Anthropic 这种高粘性租客的锁定。

在操作层面,当前应审慎对待处于高溢价状态的硬件耗材环节,关注那些能够通过技术闭环实现“成本下行、利润上行”的云平台巨头。如果 AI 对生产力的提升是确定性的,那么这场由于“去垄断化”引发的市场回撤,本质上是资产配置从“基建逻辑”转向“运营逻辑”的一次打折入场券。未来的逻辑底气,不在于算力的规模,而在于利润回流的确定性。