Triển vọng tương lai AI từ GTC: Những lĩnh vực nào được hội nghị Nvidia GTC thúc đẩy?

Hội nghị GTC 2026 của NVIDIA đã công bố các thỏa thuận và công nghệ mới, tạo cơ hội đầu tư trong chuỗi cung ứng công nghệ toàn cầu.

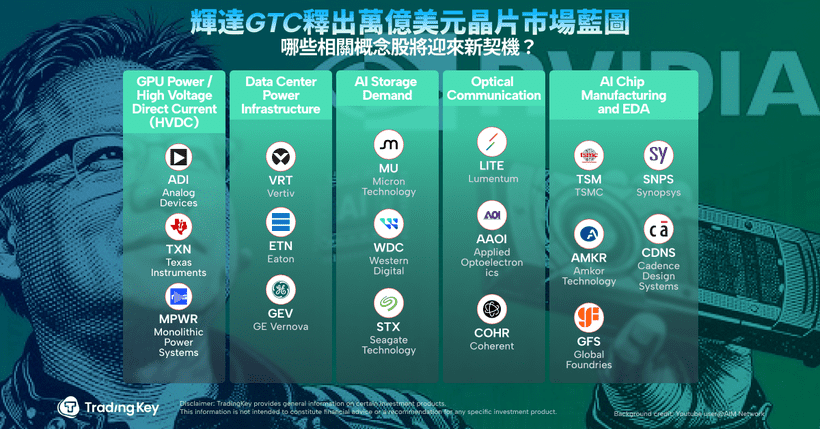

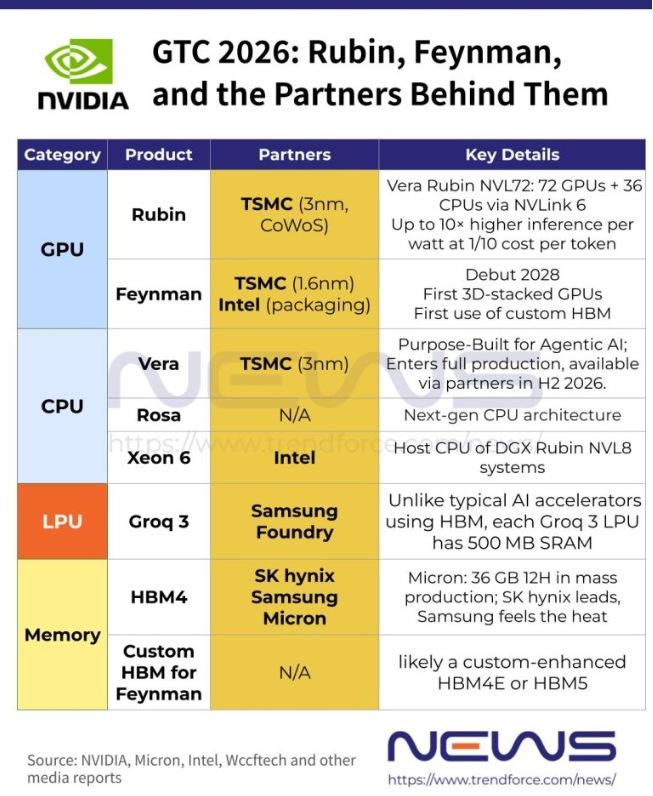

I. **Sản xuất chip AI:** Samsung sẽ gia công chip Groq 3 LPU cho NVIDIA. Intel cung cấp bộ vi xử lý Xeon 6 và hợp tác đóng gói GPU Feynman. TSMC tiếp tục là đối tác sản xuất cho GPU NVIDIA.

II. **Truyền thông quang học:** NVIDIA ra mắt chip Feynman tích hợp truyền thông quang học, giảm tiêu thụ năng lượng. Coherent và Lumentum nhận đầu tư và hợp tác với NVIDIA. Credo Technology nổi bật với giải pháp truyền dẫn quang học gần gói.

III. **Bộ nhớ AI:** Micron bắt đầu sản xuất hàng loạt HBM4 12 tầng cho nền tảng Vera Rubin. SK Hynix và SanDisk thúc đẩy tiêu chuẩn hóa công nghệ lưu trữ HBF.

IV. **Dịch vụ đám mây AI:** AWS sẽ triển khai hơn 1 triệu GPU NVIDIA. Adobe hợp tác với NVIDIA phát triển công cụ sáng tạo AI. CrowdStrike ra mắt "Security-by-Design AI Blueprint".

V. **Nguồn điện GPU:** Các công ty như Texas Instruments, ON Semiconductor, Analog Devices, và Monolithic Power Systems hưởng lợi từ xu hướng kiến trúc HVDC cho trung tâm dữ liệu AI.

VI. **Cơ sở hạ tầng điện trung tâm dữ liệu:** Flex, Eaton, Vertiv Holdings, và GE Vernova cung cấp giải pháp nguồn điện và bảo vệ cho trung tâm dữ liệu AI.

TradingKey - Trong khuôn khổ hội nghị GTC 2026, NVIDIA ( NVDA), bài phát biểu chính của CEO Jensen Huang cùng hàng loạt thỏa thuận hợp tác và công nghệ mới được ra mắt đã tạo ra những làn sóng chấn động trong chuỗi cung ứng công nghệ toàn cầu. Từ phần cứng máy tính đến các kịch bản ứng dụng, nhiều lĩnh vực đang xuất hiện những cơ hội đầu tư rõ rệt.

I. Sản xuất, gia công và đóng gói chip AI

Với tư cách là một tên tuổi kỳ cựu trong lĩnh vực chip nhớ toàn cầu, việc Samsung thâm nhập thành công vào mảng gia công chip logic cho NVIDIA chắc chắn là một bước đột phá trong phân khúc sản xuất cao cấp.

Tại hội nghị, Jensen Huang đã xác nhận rõ ràng rằng Groq 3 LPU, được thiết kế cho các kịch bản suy luận AI tốc độ cao, đang được sản xuất độc quyền tại xưởng đúc chip của Samsung. Thông tin này trực tiếp chuyển đổi vai trò của Samsung trong chuỗi cung ứng của NVIDIA từ một nhà cung cấp bộ nhớ HBM thuần túy sang mảng dịch vụ gia công chip logic cốt lõi.

Groq 3 LPU là thành phần cốt lõi trong nền tảng Vera Rubin của NVIDIA. Bộ nhớ SRAM siêu tốc 500MB tích hợp sẵn của nó cung cấp băng thông lên tới 150TB/s cho các tác vụ giải mã suy luận AI tiêu tốn nhiều băng thông, vượt xa các giải pháp lưu trữ HBM truyền thống.

Khả năng giành được đơn hàng này của Samsung không chỉ tiếp nối mối quan hệ hợp tác được thiết lập trước khi Groq được NVIDIA thâu tóm, mà còn chứng minh năng lực kỹ thuật của hãng trong quy trình sản xuất tiên tiến. Ảnh hưởng của Samsung trong thị trường gia công chip AI cao cấp được dự báo sẽ không ngừng tăng lên.

Trong khi đó, Intel ( INTC) đã chứng minh giá trị chiến lược dài hạn trong việc hợp tác với NVIDIA thông qua chiến lược tiếp cận kép.

Một mặt, Intel chính thức xác nhận bộ vi xử lý Xeon 6 của mình sẽ cung cấp khả năng tính toán cho hệ thống NVIDIA DGX Rubin NVL8. Bộ vi xử lý này mang lại băng thông bộ nhớ tăng gấp 2,3 lần so với thế hệ trước, đáp ứng hoàn hảo yêu cầu về khối lượng công việc tăng tốc của các GPU thế hệ tiếp theo và cung cấp nền tảng tính toán hiệu năng cao có khả năng mở rộng cho các trung tâm dữ liệu AI.

Mặt khác, những thông tin mang tính định hướng tương lai hơn cho thấy NVIDIA có ý định hợp tác gia công sâu rộng với Intel, sử dụng các công nghệ đóng gói tiên tiến của Intel — bao gồm EMIB — để hỗ trợ đóng gói cho GPU Feynman dự kiến ra mắt vào năm 2026.

Đáng chú ý, trong khi tấm bán dẫn (die) của GPU Feynman dự kiến được sản xuất trên quy trình 1,6nm của TSMC, việc Intel tham gia vào giai đoạn đóng gói cho thấy công nghệ đóng gói tiên tiến của hãng đã được các đối tác hàng đầu trong ngành công nhận, từ đó làm nổi bật thêm khả năng cạnh tranh trong thị trường đóng gói chip cao cấp.

TSMC ( TSM) và NVIDIA là hình mẫu điển hình về sự cộng sinh chiến lược trong kỷ nguyên AI. Tận dụng các tiến trình sản xuất tiên tiến hàng đầu (như 4nm và 3nm) cùng công nghệ đóng gói tiên tiến CoWoS, TSMC đã trở thành đối tác gia công cốt lõi cho các GPU hiệu năng cao của NVIDIA.

Kiến trúc Feynman sắp tới, sản phẩm cốt lõi thế hệ tiếp theo của NVIDIA sau Rubin, sẽ sử dụng quy trình 1,6nm A16 của TSMC. Thúc đẩy bởi tin tức tích cực này, cổ phiếu niêm yết tại Mỹ của TSMC đã tăng 1,69% trong phiên giao dịch ngày thứ Ba.

II. Truyền thông quang học (Mạng lưới AI)

Kết nối liên kết giữa các chip, cốt lõi của hạ tầng tính toán AI toàn cầu, đang trải qua một bước nhảy vọt lịch sử từ "điện" sang "quang". Vào ngày 16 tháng 3 (giờ địa phương), NVIDIA đã ra mắt chip Feynman, lần đầu tiên đưa truyền thông quang học vào kết nối giữa các chip, giúp giảm mức tiêu thụ năng lượng truyền thông trong trung tâm dữ liệu AI hơn 70%.

Trong làn sóng công nghiệp về truyền thông quang học này, Coherent ( COHR ), một nhà sản xuất linh kiện truyền thông quang học, trước đó đã nhận được khoản đầu tư chiến lược trị giá 2 tỷ USD từ NVIDIA, với cả hai bên cùng ký kết một thỏa thuận mua sắm dài hạn. Mối quan hệ đối tác lớn này đã trực tiếp đẩy giá cổ phiếu của Coherent tăng gần 7%.

Trong tương lai, Coherent sẽ tham gia sâu vào lộ trình công nghệ quang học trong hạ tầng AI của NVIDIA, cung cấp các giải pháp truyền thông quang học băng thông cao, tiêu thụ điện năng thấp cho các cụm máy tính của hãng. Với tầm ảnh hưởng trong ngành của NVIDIA, thị phần của Coherent trong thị trường truyền thông quang học AI được kỳ vọng sẽ mở rộng nhanh chóng.

Lumentum ( LITE ), công ty cũng nhận được khoản đầu tư 2 tỷ USD từ NVIDIA, đã giành được vị thế thuận lợi trong đợt nâng cấp truyền thông AI này. Lumentum sở hữu chuyên môn kỹ thuật sâu về chip laser và module quang học. Việc hợp tác với NVIDIA không chỉ mang lại nguồn vốn dồi dào để đẩy nhanh việc mở rộng công suất mà còn cho phép hãng tối ưu hóa công nghệ sản phẩm dành riêng cho các trường hợp sử dụng AI của NVIDIA.

Khi nhu cầu về các module quang học tốc độ cao trong các cụm máy tính AI tiếp tục tăng lên, các lợi thế sản xuất và sức mạnh kỹ thuật của Lumentum sẽ được tận dụng triệt để, biến hãng trở thành một mắt xích then chốt trong chuỗi cung ứng truyền thông quang học AI.

Trong khi đó, Credo Technology ( CRDO) được kỳ vọng sẽ trở thành "ngựa ô" trong lĩnh vực kết nối AI tầm ngắn nhờ lộ trình kỹ thuật độc đáo. Giải pháp truyền dẫn quang học gần gói (near-package) sử dụng microLED của công ty giúp rút ngắn đáng kể đường truyền tín hiệu bằng cách đóng gói các linh kiện quang học ngay gần chip, giảm tổng điện năng tiêu thụ cho kết nối trong các trung tâm dữ liệu xuống chỉ còn khoảng 5% so với các giải pháp đồng truyền thống, đồng thời cung cấp băng thông cao hơn.

Trong kỷ nguyên mà các cụm máy tính AI không ngừng theo đuổi các chỉ số hiệu quả năng lượng, những ưu điểm của giải pháp này là rất rõ ràng. Nhờ đó, Credo Technology đã có được không gian tăng trưởng rộng mở, và triển vọng của hãng sẽ còn ấn tượng hơn nữa nếu gia nhập thành công vào chuỗi cung ứng của NVIDIA.

III. Nhu cầu bộ nhớ AI

Micron ( MU) đã đập tan những tin đồn thị trường trước đó bằng hành động thực tế, tái khẳng định vị thế cốt lõi của mình trong chuỗi cung ứng của NVIDIA.

Tại hội nghị GTC, Micron đã chính thức thông báo rằng dòng HBM4 12 tầng dung lượng 36GB của hãng đã bắt đầu được sản xuất hàng loạt cho nền tảng Vera Rubin của NVIDIA vào quý 1/2026. Sản phẩm này có tốc độ chân tín hiệu vượt quá 11 Gb/s và băng thông trên mỗi tấm bán dẫn đơn đạt hơn 2,8 TB/s — tăng 2,3 lần hiệu suất so với HBM3E với hiệu quả sử dụng điện năng tốt hơn hơn 20%, đáp ứng đầy đủ nhu cầu băng thông cực lớn của các nền tảng tính toán AI thế hệ tiếp theo.

Những tin đồn trước đó cho rằng Micron bị loại khỏi chuỗi cung ứng cho Vera Rubin. Việc công bố sản xuất hàng loạt không chỉ dập tắt những tin đồn đó mà còn đưa Micron trở thành nhà cung cấp bộ nhớ cốt lõi cho thế hệ nền tảng AI mới của NVIDIA.

Đồng thời, Micron cũng tiết lộ đã bắt đầu gửi mẫu HBM4 16 tầng dung lượng 48GB tới khách hàng, thể hiện năng lực dự phòng kỹ thuật trong phân khúc bộ nhớ cao cấp và tạo nền tảng để chiếm lĩnh thêm thị phần bộ nhớ AI. Giá cổ phiếu của hãng đã tăng 4,5% sau hội nghị.

SK Hynix và SanDisk ( SNDK) đã mở ra tiềm năng tăng trưởng dài hạn thông qua việc triển khai các công nghệ bộ nhớ mới. Cả hai đã cùng nhau khởi xướng một quy trình làm việc OCP (Dự án Tính toán Mở) nhằm thúc đẩy tiêu chuẩn hóa công nghệ lưu trữ HBF. Với tư cách là một lớp bộ nhớ bổ sung giữa HBM và SSD, HBF cung cấp tốc độ tương đương HBM nhưng có dung lượng của SSD trong các kịch bản suy luận AI, giúp cân bằng giữa hiệu suất và chi phí.

Phấn khởi trước thông tin từ hội nghị, cổ phiếu của SK Hynix tại Hàn Quốc đã tăng hơn 8% vào thứ Tư, và cổ phiếu của SanDisk ghi nhận mức tăng 2,35% vào thứ Ba.

IV. Dịch vụ đám mây AI

Việc triển khai công nghệ AI đang tái định hình các mô hình dịch vụ trên khắp các ngành công nghiệp. Bức tranh dịch vụ và ứng dụng AI được xây dựng xung quanh hệ sinh thái tính toán của NVIDIA đang trở thành một chiến trường mới cho các gã khổng lồ công nghệ và các đơn vị chuyên biệt theo ngành dọc.

Với tư cách là công ty dẫn đầu toàn cầu về điện toán đám mây, Amazon ( AMZN) đã thực hiện một bước quan trọng khác trong chiến lược tính toán AI của mình. Vào năm 2026, AWS sẽ triển khai hơn 1 triệu GPU NVIDIA. Khoản đầu tư khổng lồ này không chỉ cung cấp cho AWS khả năng hỗ trợ AI mạnh mẽ hơn mà còn biến hãng trở thành nhà cung cấp dịch vụ đám mây lớn đầu tiên hỗ trợ phiên bản máy chủ RTX PRO 4500 Blackwell.

Dòng GPU máy chủ dựa trên kiến trúc Blackwell này, vốn được tối ưu hóa cho việc huấn luyện và suy luận AI, cung cấp cho người dùng doanh nghiệp các giải pháp tính toán AI hiệu quả hơn.

Ngoài điện toán đám mây, Amazon sẽ hợp tác với NVIDIA để phát triển trợ lý Alexa đa phương thức cho xe hơi, tận dụng các chip AI và thuật toán của NVIDIA để mở rộng phạm vi tiếp cận của Alexa trong ô tô thông minh. Với sự tiến triển ở cả mảng đám mây và xe thông minh, Amazon sẽ được hưởng lợi trọn vẹn từ cuộc chuyển đổi công nghiệp của kỷ nguyên AI. Giá cổ phiếu của hãng ghi nhận mức tăng 1,63% vào thứ Ba.

Adobe ( ADBE) đã củng cố vị thế dẫn đầu trong lĩnh vực thiết kế sáng tạo thông qua sự hợp tác kỹ thuật với NVIDIA. Các mô hình AI thế hệ mới do hai bên cùng phát triển đã trang bị cho các công cụ sáng tạo của Adobe khả năng AI mạnh mẽ hơn, trong khi việc ra mắt bản thử nghiệm công khai (public beta) cho giải pháp bản sao kỹ thuật số 3D dựa trên nền tảng đám mây đánh dấu một bước đột phá quan trọng của Adobe trong các ứng dụng sáng tạo AI.

Giải pháp này, dựa trên sức mạnh tính toán hiệu năng cao của NVIDIA, cho phép các chuyên gia sáng tạo nhanh chóng xây dựng các bối cảnh bản sao kỹ thuật số 3D có độ chính xác cao, được ứng dụng rộng rãi trong kiến trúc, điện ảnh và truyền hình, trò chơi điện tử và các lĩnh vực khác. Bằng cách tích hợp sâu công nghệ AI vào quy trình làm việc sáng tạo, Adobe không chỉ nâng cao khả năng cạnh tranh của sản phẩm mà còn đưa ra những hướng đi mới cho quá trình chuyển đổi số của ngành sáng tạo.

CrowdStrike ( CRWD) đã kết hợp nền tảng Falcon của mình với NVIDIA OpenShell để ra mắt "Security-by-Design AI Blueprint" (Bản thiết kế AI bảo mật từ khâu thiết kế), cung cấp sự bảo vệ an ninh toàn vòng đời từ phát triển đến triển khai cho các tác nhân AI tự chủ. Giá cổ phiếu của công ty đã tăng 2,21% vào thứ Ba.

Sự hợp tác này đánh dấu việc CrowdStrike chính thức gia nhập thị trường bảo mật tác nhân tự chủ AI đang tăng trưởng nhanh chóng. Thông qua việc liên kết sâu rộng với hệ sinh thái AI của NVIDIA, công ty kỳ vọng sẽ thu hút thêm nhiều khách hàng doanh nghiệp đang tìm cách bảo vệ các hệ thống AI trên thiết bị và trên đám mây.

Các nhà phân tích tin rằng động thái này không chỉ củng cố vị thế dẫn đầu của CrowdStrike trong lĩnh vực an ninh mạng mà còn mở ra cơ hội tăng trưởng trong thị trường bảo mật AI thế hệ mới, với tiềm năng hứa hẹn về doanh thu tăng thêm.

V. Nguồn điện cho GPU / Dòng điện một chiều cao áp (HVDC)

Khi nhu cầu về sức mạnh tính toán để huấn luyện các mô hình AI lớn tăng theo cấp số nhân, mức tiêu thụ điện năng của từng GPU riêng lẻ tiếp tục tăng cao. Các kiến trúc điện xoay chiều (AC) truyền thống gặp khó khăn trong việc đáp ứng các yêu cầu cung cấp điện hiệu quả cho các máy chủ AI. Kiến trúc dòng điện một chiều cao áp (HVDC), với ưu điểm là hiệu suất chuyển đổi cao và tổn thất truyền tải thấp, đang ngày càng trở thành xu hướng mới trong các giải pháp nguồn điện cho trung tâm dữ liệu.

Texas Instruments ( TXN ), ON Semiconductor ( ON ), Analog Devices ( ADI ), và các gã khổng lồ khác trong ngành, tận dụng chuyên môn kỹ thuật trong lĩnh vực quản lý nguồn điện HVDC, đã trở thành những bên hưởng lợi trực tiếp từ xu hướng này.

Texas Instruments không chỉ thông báo tại hội nghị GTC 2026 rằng họ đang hợp tác với NVIDIA để đẩy nhanh việc triển khai an toàn robot hình người — tích hợp các công nghệ điều khiển động cơ thời gian thực, cảm biến và nguồn điện của mình với nền tảng tính toán robot của NVIDIA — mà còn giới thiệu một loạt các giải pháp quản lý nguồn điện hiệu suất cao cho kiến trúc nguồn 48V của các trung tâm dữ liệu AI, với doanh thu của đơn vị kinh doanh trung tâm dữ liệu tăng vọt 70% so với cùng kỳ năm trước trong quý 4 năm 2025.

ON Semiconductor tập trung vào chuỗi chuyển đổi điện năng từ lưới điện sang GPU, cung cấp các giải pháp chuyển đổi AC-DC và DC-DC hiệu suất cao cho các tủ thiết bị có mật độ công suất cao trong các trung tâm dữ liệu AI. Các sản phẩm quản lý nguồn điện của hãng đã trở thành linh kiện quan trọng trong chuỗi cung ứng máy chủ AI của NVIDIA.

Các chip giám sát và chuyển đổi nguồn điện độ chính xác cao của Analog Devices cũng được sử dụng rộng rãi trong các cụm tính toán AI của NVIDIA, mang lại sự đảm bảo tin cậy cho sự vận hành ổn định của các GPU.

Sau hội nghị GTC 2026, cổ phiếu của Texas Instruments đã tăng 3,2% vào thứ Ba, ON Semiconductor tăng 2,8% và Analog Devices tăng 2,1%, phản ánh đầy đủ sự công nhận của thị trường đối với tiềm năng tăng trưởng của họ trong lĩnh vực nguồn điện cho AI.

Monolithic Power Systems ( MPWR) cũng nắm giữ một vị trí quan trọng trong làn sóng nâng cấp nguồn điện cho AI. Các giải pháp nguồn điện hiệu suất cao mà công ty phát triển được tối ưu hóa sâu cho các đặc tính tiêu thụ điện năng cao của máy chủ AI, giảm thiểu tổn thất năng lượng trong quá trình chuyển đổi điện năng đồng thời đáp ứng nhu cầu công suất đỉnh của GPU.

Với sự mở rộng liên tục của các cụm tính toán AI, các sản phẩm của MPWR sẽ đối mặt với không gian thị trường rộng lớn hơn, và giá cổ phiếu của hãng cũng tăng 1,5% sau hội nghị.

Đồng thời, STMicroelectronics ( STM ), Infineon (IFNNY), ROHM Semiconductor (ROHCY) và Renesas Electronics (RNECY) cũng được kỳ vọng sẽ hưởng lợi.

VI. Cơ sở hạ tầng nguồn điện trung tâm dữ liệu

Việc triển khai quy mô lớn các cụm tính toán AI không chỉ đặt ra yêu cầu cao hơn đối với các giải pháp nguồn điện bên trong máy chủ mà còn mang lại những thách thức đáng kể cho tổng thể cơ sở hạ tầng điện của trung tâm dữ liệu.

Flex ( FLEX) với tư cách là nhà cung cấp dịch vụ sản xuất điện tử hàng đầu thế giới, duy trì mối quan hệ đối tác chặt chẽ với NVIDIA, chế tạo các thành phần nguồn điện tùy chỉnh và dịch vụ tích hợp dành riêng cho các máy chủ AI của mình. Tận dụng sự hiểu biết sâu sắc về nền tảng tính toán AI của NVIDIA, Flex có thể đáp ứng chính xác các yêu cầu cung cấp điện trong nhiều tình huống khác nhau, đảm bảo các giải pháp vừa có độ tin cậy cao vừa có khả năng mở rộng, phù hợp hoàn hảo với tốc độ mở rộng nhanh chóng của các cụm tính toán AI.

Eaton ( ETN) đã trở thành bên bảo vệ nguồn điện cốt lõi cho các trung tâm dữ liệu AI với hệ thống phân phối điện thông minh và thiết bị UPS công suất lớn; Vertiv Holdings ( VRT) cung cấp các giải pháp tích hợp từ phân phối điện áp cao, bộ lưu điện (UPS) đến làm mát chính xác, xây dựng một hệ sinh thái năng lượng vừa có khả năng phục hồi vừa tiết kiệm năng lượng; GE Vernova ( GEV) tận dụng chuyên môn trong công nghệ quản lý điện năng quy mô lưới điện để cung cấp hỗ trợ kỹ thuật toàn quy trình cho các trung tâm dữ liệu AI, từ kết nối lưới điện đến điều phối phụ tải.

Khi các cụm tính toán AI của NVIDIA tiếp tục mở rộng, nhu cầu thị trường đối với các công ty này cũng sẽ tăng lên. Giá cổ phiếu của họ đều ghi nhận các mức tăng khác nhau sau hội nghị: Vertiv Holdings tăng 2,5%, Eaton tăng 1,8% và GE Vernova tăng 1,2%.

Kết luận

Những tín hiệu được NVIDIA đưa ra tại GTC không chỉ cho thấy hướng tiến hóa của công nghệ của chính họ mà còn phác thảo một bản thiết kế tương lai cho ngành công nghiệp AI.

Các nhà phân tích tại Wedbush ước tính rằng cứ mỗi 1 USD chi cho chip NVIDIA sẽ tạo ra hiệu ứng số nhân từ 8 đến 10 USD trong hệ sinh thái công nghệ. Khi ngành công nghiệp AI bước vào giai đoạn tăng trưởng cao, các công ty trong sáu phân khúc này chắc chắn sẽ trở thành những bên tham gia cốt lõi tiếp tục hưởng lợi từ làn sóng công nghệ này, và tiềm năng tăng trưởng dài hạn của họ xứng đáng nhận được sự quan tâm đáng kể từ thị trường.

Nội dung này được dịch bằng trí tuệ nhân tạo và đã được hiệu đính cho dễ hiểu hơn. Chỉ mang tính chất tham khảo.

Bài viết đề xuất