อัลกอริทึมการบีบอัด TurboQuant ของ Google คืออะไร? และจะส่งผลกระทบต่ออุตสาหกรรมชิปจัดเก็บข้อมูลสำหรับ AI อย่างไร?

Google Research เปิดตัว TurboQuant อัลกอริทึมบีบอัดเวกเตอร์ ลดการใช้หน่วยความจำ KV Cache ใน AI inference ได้ถึง 6 เท่า โดยไม่กระทบความแม่นยำ ประสิทธิภาพการประมวลผลเพิ่มขึ้นสูงสุด 8 เท่า

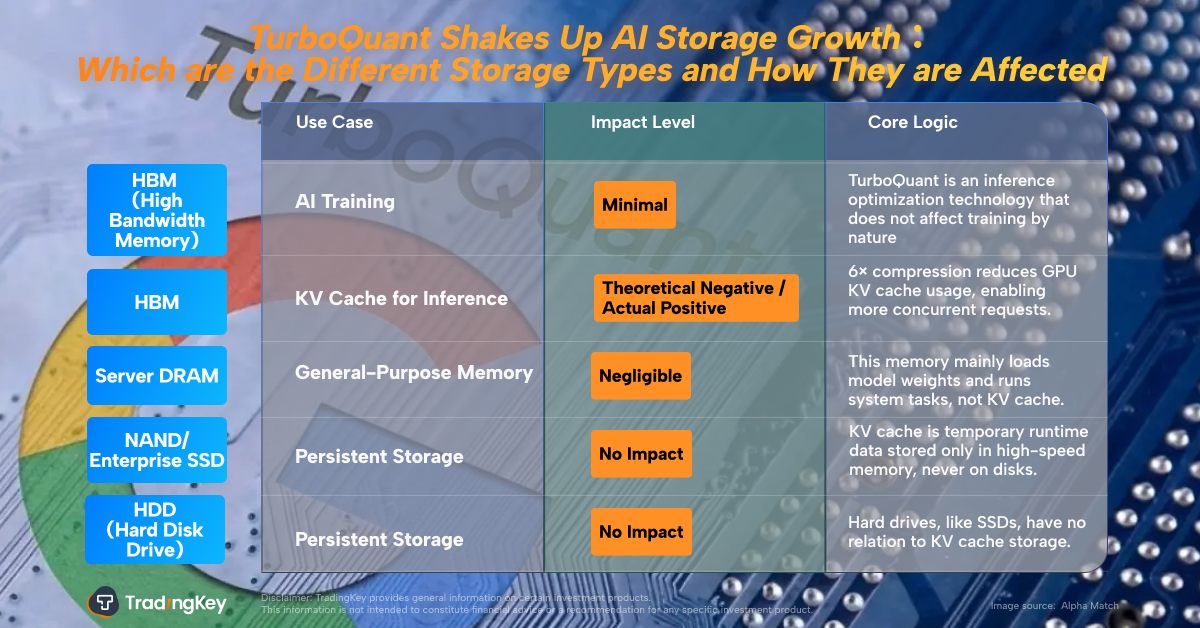

TurboQuant ใช้ PolarQuant และ QJL จัดการ KV Cache ลดภาระหน่วยความจำ ช่วยให้รันโมเดลใหญ่ขึ้นบนอุปกรณ์ที่มีข้อจำกัด ส่งผลดีต่อ HBM แต่กระทบ Server DRAM และ NAND Flash เล็กน้อย

แม้จะมีความท้าทายเรื่องความแม่นยำและข้อจำกัดฮาร์ดแวร์ เทคโนโลยีนี้คาดว่าจะเร่งการใช้งาน AI ต้นทุนต่ำ เพิ่มความต้องการหน่วยความจำโดยรวม และเปลี่ยนโครงสร้างตลาดอุปกรณ์จัดเก็บข้อมูล AI

TradingKey - Google ( GOOGL) ( GOOG ) การเปิดตัวอัลกอริทึมการบีบอัดเวกเตอร์ TurboQuant เปรียบเสมือนการขว้างหินที่แม่นยำ ซึ่งสร้างแรงกระเพื่อมไปทั่วอุตสาหกรรมชิปหน่วยความจำ AI

อัลกอริทึมการบีบอัดเวกเตอร์ใหม่นี้ได้รับการปรับแต่งมาเป็นพิเศษเพื่อประสิทธิภาพการใช้หน่วยความจำในช่วงขั้นตอนการอนุมานของ AI (AI inference phase) โดยมีความโดดเด่นอย่างยิ่งในการแก้ปัญหาการครองพื้นที่ Key-Value Cache (KV Cache) ในระดับสูง ซึ่งหมายความว่าโมเดล AI จะสามารถประมวลผลข้อมูลได้มากขึ้นด้วยการใช้หน่วยความจำที่ลดลง ขณะเดียวกันก็นำมาซึ่งความท้าทายใหม่ๆ สำหรับอุตสาหกรรม

ดังนั้น TurboQuant คืออะไรกันแน่? มีข้อได้เปรียบทางเทคนิคที่โดดเด่นอย่างไร? และจะส่งผลกระทบต่ออุตสาหกรรมหน่วยความจำ AI อย่างไร?

TurboQuant คืออะไร?

TurboQuant เป็นอัลกอริทึมการบีบอัดเวกเตอร์ (vector compression) ใหม่ที่เปิดตัวอย่างเป็นทางการโดย Google Research ในเดือนมีนาคม 2026 โดยมีเป้าหมายเพื่อแก้ปัญหาสำคัญในขั้นตอนการประมวลผล (inference) ของโมเดลภาษาขนาดใหญ่ (LLMs) และเครื่องมือค้นหาเวกเตอร์ (vector search engines) นั่นคือการใช้หน่วยความจำมหาศาลของ Key-Value Cache (KV Cache) ทั้งนี้ รายละเอียดทางเทคนิคจะถูกเผยแพร่อย่างเป็นทางการและผ่านการพิจารณาโดยผู้ทรงคุณวุฒิในรูปแบบของบทความวิชาการในงาน ICLR 2026 (International Conference on Learning Representations) ระหว่างวันที่ 23 ถึง 27 เมษายน

ในระหว่างกระบวนการประมวลผลของโมเดลภาษาขนาดใหญ่ KV Cache จะทำหน้าที่เป็น "สมุดบันทึกชั่วคราว" ของโมเดล โดยบทสนทนาทุกรอบและส่วนของข้อความที่ป้อนเข้ามาจะถูกแปลงเป็นเวกเตอร์หลายมิติและจัดเก็บไว้ชั่วคราวเพื่อให้ข้อมูลบริบทสำหรับขั้นตอนการประมวลผลถัดไป เพื่อให้มั่นใจในความแม่นยำของการประมวลผล โดยทั่วไปแล้วโซลูชันแบบดั้งเดิมจะจัดเก็บข้อมูลเวกเตอร์ในรูปแบบทศนิยม 16 บิต (FP16/BF16) อย่างไรก็ตาม เมื่อความยาวของบทสนทนาเพิ่มขึ้นหรือขนาดของข้อความขยายตัว KV Cache จะใช้หน่วยความจำแบนด์วิดท์สูง (high-bandwidth memory) ของ GPU ราวกับเป็น "หลุมดำของข้อมูล" ซึ่งไม่เพียงแต่ทำให้การประมวลผลช้าลงเท่านั้น แต่ยังทำให้ต้นทุนการคำนวณสูงขึ้นอย่างมาก จนกลายเป็นอุปสรรคสำคัญ (bottleneck) ในการติดตั้งใช้งานโมเดลขนาดใหญ่

ความคิดเห็นส่วนใหญ่ในอุตสาหกรรมชี้ให้เห็นว่า อุปสรรคของโมเดลขนาดใหญ่ในปัจจุบันไม่ใช่จำนวนพารามิเตอร์ แต่คือความจุของหน่วยความจำ ยิ่งบริบทมีความยาวมากเท่าใด ปริมาณการใช้หน่วยความจำของ KV Cache ก็จะยิ่งมากขึ้นเท่านั้น จนในที่สุดก็ถึงขีดจำกัดของฮาร์ดแวร์ก่อนที่พารามิเตอร์ของโมเดลจะถึงเสียอีก ซึ่งถือเป็นปัญหาหลักที่พบร่วมกันในงานต่างๆ เช่น การสร้างข้อความขนาดยาว และการทำความเข้าใจเอกสารที่มีความยาวมาก

ความสำเร็จที่ก้าวล้ำของ TurboQuant เข้ามาช่วยแก้ไขปัญหาดังกล่าวได้โดยตรง

ด้วยการผสานพลังของเทคโนโลยีพื้นฐานสองประการ TurboQuant จึงสามารถบีบอัด KV Cache ได้อย่างมีประสิทธิภาพสูงสุด โดยไม่มีภาระหน่วยความจำเพิ่มเติม (zero additional memory overhead) และแทบจะไม่ส่งผลกระทบต่อความแม่นยำในการประมวลผล

ขั้นตอนแรกใช้ PolarQuant สำหรับการบีบอัดขั้นต้น โดยการเปลี่ยนตรรกะการเข้ารหัสพิกัดคาร์ทีเซียน (Cartesian coordinate - XYZ) แบบดั้งเดิมของเวกเตอร์ในโมเดล AI ให้เป็นพิกัดเชิงขั้ว (polar coordinates) ตัวอย่างเช่น ในขณะที่การเข้ารหัสแบบเดิมเปรียบเสมือนการบอกว่า "เดินไปทางตะวันออก 3 บล็อกและทางเหนือ 4 บล็อก" พิกัดเชิงขั้วจะอธิบายว่า "เดินไป 5 บล็อกในมุม 37 องศา" ซึ่งทำให้เวกเตอร์ง่ายขึ้นเป็น "รัศมี (ความเข้มข้นของข้อมูลหลัก) + ทิศทาง (ความหมายของข้อมูล)" การเปลี่ยนแปลงนี้จะจับคู่เวกเตอร์ลงบน "โครงข่ายวงกลม" ที่มีขอบเขตคงที่ ช่วยลดขั้นตอนการปรับข้อมูลให้เป็นมาตรฐาน (data normalization) ที่มีค่าใช้จ่ายสูงซึ่งจำเป็นในวิธีแบบดั้งเดิม ลดการจัดเก็บข้อมูลที่ซ้ำซ้อนจากต้นตอ และช่วยลดการใช้หน่วยความจำส่วนใหญ่ลงได้

ขั้นตอนที่สองใช้เทคโนโลยี QJL (Quantized Johnson-Lindenstrauss) เพื่อจัดการกับข้อผิดพลาดที่เหลือ (residual errors) แม้ว่า PolarQuant จะสามารถบีบอัดได้อย่างมีประสิทธิภาพ แต่อาจทำให้ความแม่นยำคลาดเคลื่อนเล็กน้อย โดย QJL จะใช้กำลังการคำนวณเพียง 1 บิต เพื่อเพิ่มเครื่องหมายแก้ไข +1 หรือ -1 ให้กับแต่ละเวกเตอร์ ทำหน้าที่เป็น "เครื่องจักรแก้ไขข้อผิดพลาดทางคณิตศาสตร์" เพื่อปรับข้อผิดพลาดเหล่านี้ให้ราบรื่นในขณะที่ยังคงรักษาความสัมพันธ์ระหว่างเวกเตอร์ไว้ได้อย่างครบถ้วน สิ่งนี้ช่วยให้มั่นใจได้ว่าโมเดลจะคำนวณคะแนนความสนใจ (attention scores) ได้อย่างแม่นยำ ซึ่งเป็นกระบวนการหลักสำหรับโครงข่ายประสาทเทียมในการตัดสินความสำคัญของข้อมูล โดยขั้นตอนการแก้ไขทั้งหมดนี้จะไม่ก่อให้เกิดภาระหน่วยความจำเพิ่มเติมแต่อย่างใด

TurboQuant เป็นผู้นำในด้านตัวชี้วัดผลการดำเนินงาน

TurboQuant ของ Google ประสบความสำเร็จในด้านประสิทธิภาพและการบีบอัดที่ก้าวล้ำ โดยสามารถบีบอัดข้อมูลเวกเตอร์ขนาด 32 บิต หรือ 16 บิต ให้เหลือเพียงประมาณ 3 บิต ด้วยอัตราการบีบอัดที่สูงถึง 6 เท่า ซึ่งช่วยลดการใช้พื้นที่หน่วยความจำของ KV Cache ในโมเดลขนาดใหญ่ลงเหลือเพียงหนึ่งในหกของระดับเดิมได้โดยตรง

ในการทดสอบเกณฑ์มาตรฐานด้านฮาร์ดแวร์ อัลกอริทึมดังกล่าวแสดงให้เห็นถึงข้อได้เปรียบด้านความเร็วอย่างมีนัยสำคัญบนอุปกรณ์ต่างๆ เช่น NVIDIA H100 โดยมีประสิทธิภาพการคำนวณเพิ่มขึ้นสูงสุดถึง 8 เท่า

ที่สำคัญคือ กระบวนการทั้งหมดไม่จำเป็นต้องมีการฝึกฝนล่วงหน้าหรือการปรับจูนเพื่อบรรลุผลลัพธ์แบบ "zero precision loss" โดยประสิทธิภาพในภารกิจต่างๆ เช่น การตอบคำถาม การสร้างโค้ด และการสรุปข้อความยาว ยังคงแทบไม่ลดลง และไม่จำเป็นต้องปรับจูนพารามิเตอร์ในชุดข้อมูลเฉพาะเจาะจง ทำให้สามารถปรับใช้กับสถานการณ์การอนุมานของโมเดลขนาดใหญ่ที่หลากหลายได้โดยตรง

ในการทดสอบการค้นหาเวกเตอร์ TurboQuant ยังทำผลงานได้เหนือกว่าวิธีการทำ Product Quantization แบบดั้งเดิม โดยในขณะที่ยังรักษาอัตรา Recall ไว้ได้ แต่สามารถลดเวลาในการสร้างดัชนีลงจนเกือบเป็นศูนย์ ซึ่งมีความสำคัญอย่างยิ่งต่อเครื่องมือค้นหาสมัยใหม่ที่พึ่งพาการจับคู่เวกเตอร์เชิงความหมาย ปัจจุบันเครื่องมือค้นหากระแสหลักใช้เวกเตอร์หลายมิติหลายพันล้านรายการเพื่อการสืบค้นข้อมูลเชิงความหมายที่แม่นยำ อัตราการบีบอัดที่สูงของ TurboQuant จึงช่วยลดต้นทุนการจัดเก็บข้อมูลโดยตรง พร้อมทั้งเพิ่มความเร็วในการตอบสนอง สร้างพื้นที่ใหม่สำหรับการเพิ่มประสิทธิภาพการค้นหาเชิงความหมายขนาดใหญ่

จากมุมมองของการนำไปใช้งาน TurboQuant ช่วยลดต้นทุนการดำเนินงานและความต้องการหน่วยความจำของโมเดล AI โดยตรง ช่วยให้สามารถสร้างผลลัพธ์ในเครื่อง (local) ที่มีคุณภาพสูงขึ้นบนอุปกรณ์เคลื่อนที่ที่มีข้อจำกัดด้านฮาร์ดแวร์ เช่น สมาร์ทโฟน นอกจากนี้ พื้นที่หน่วยความจำที่ได้รับคืนมายังช่วยให้สามารถรันโมเดลที่มีความซับซ้อนมากขึ้นได้ ซึ่งน่าจะนำไปสู่แนวโน้มการใช้งานในอนาคตที่เน้น "การลดต้นทุนและอัปเกรดโมเดล" ไปพร้อมกัน

ผลกระทบของ TurboQuant ต่อชิปหน่วยความจำ

ตลาดฮาร์ดแวร์ AI ในปัจจุบันตกอยู่ในภาวะกลืนไม่เข้าคายไม่ออกอย่างรุนแรงจาก "ราคาที่พุ่งสูงและอุปทานที่ตึงตัว" ซึ่งทรัพยากรจัดเก็บข้อมูลที่มีแบนด์วิดท์สูงและความจุขนาดใหญ่ได้กลายเป็นคอขวดสำคัญที่ขัดขวางการนำ AI มาใช้งานในวงกว้าง เพื่อตอบสนองความต้องการแบนด์วิดท์ที่สูงเป็นพิเศษสำหรับการฝึกฝนและการประมวลผล (Inference) โมเดลขนาดใหญ่ เซิร์ฟเวอร์ AI จึงต้องพึ่งพา HBM (High Bandwidth Memory) อย่างหนัก ซึ่งส่งผลโดยตรงให้ราคาตลาดพุ่งสูงขึ้นและเกิดภาวะขาดแคลนอุปทานทั่วโลกอย่างต่อเนื่อง

เพื่อให้สามารถรองรับการทำงานของโมเดลขนาดใหญ่ บรรดาองค์กรต่าง ๆ จึงถูกบีบให้ต้องใช้วิธีการแบบ "ระดมติดตั้งฮาร์ดแวร์" (hardware stacking) ซึ่งทำให้ต้นทุนในการปรับใช้และการดำเนินงานของ AI ยังคงอยู่ในระดับที่สูงจนเกินไป อย่างไรก็ตาม การปรากฏขึ้นของเทคโนโลยี TurboQuant ของ Google อาจพร้อมที่จะเข้ามาเปลี่ยนตรรกะของความต้องการชิปหน่วยความจำประเภทต่าง ๆ

Server DRAM (DDR5)

เป้าหมายการเพิ่มประสิทธิภาพของ TurboQuant ถูกล็อกไว้ที่โมดูล KV cache และดัชนีเวกเตอร์ (vector index) อย่างแม่นยำ ซึ่งเป็นส่วนประกอบที่ใช้หน่วยความจำมากที่สุดในสถานการณ์การประมวลผล (Inference) AI เมื่อเทคโนโลยีนี้ถูกนำมาใช้งานในวงกว้าง เซิร์ฟเวอร์เพียงเครื่องเดียวจะมีความสามารถในการ "รองรับโมเดลได้มากขึ้นโดยใช้หน่วยความจำน้อยลง" สิ่งนี้ได้กระตุ้นความกังวลในตลาดว่าอัตราการเติบโตของความต้องการความจุ DRAM อาจชะลอตัวลง ซึ่งเป็นสาเหตุโดยตรงของการเปลี่ยนแปลงบรรยากาศในตลาดเมื่อเร็ว ๆ นี้

อย่างไรก็ตาม แรงหนุนจากภาพรวมอุปสงค์และอุปทานจริงยังคงแข็งแกร่ง รายงานอุตสาหกรรมของ TrendForce สำหรับไตรมาสแรกของปี 2569 ระบุว่าราคาล่วงหน้า (contract prices) ของ DRAM มาตรฐานคาดว่าจะเพิ่มขึ้น 55%-60% เมื่อเทียบกับไตรมาสก่อนหน้า เนื่องจากช่องว่างระหว่างอุปสงค์และอุปทานยังคงขยายตัวกว้างขึ้น

HBM (High Bandwidth Memory)

ในฐานะที่เป็นสื่อจัดเก็บข้อมูลหลักสำหรับสถานการณ์การฝึกฝน (Training) AI ตัว HBM แทบจะไม่ได้รับผลกระทบใด ๆ จาก TurboQuant เนื่องจาก TurboQuant เป็นเทคโนโลยีเพิ่มประสิทธิภาพการประมวลผล (Inference) โดยพื้นฐาน ซึ่งไม่ได้เกี่ยวข้องกับตรรกะของหน่วยความจำสำหรับการฝึกฝนตั้งแต่ขั้นตอนการออกแบบ ความต้องการแบนด์วิดท์สูงและความจุขนาดใหญ่ของ HBM ในการฝึกฝน AI ยังคงเพิ่มขึ้นอย่างต่อเนื่อง และสถานการณ์อุปสงค์อุปทานที่ตึงตัวจะยังคงไม่เปลี่ยนแปลง

ในสถานการณ์การประมวลผล (Inference) HBM กลับมีโอกาสที่จะได้รับประโยชน์เพิ่มเติมจาก TurboQuant ด้วยอัตราการบีบอัด 6 เท่า เทคโนโลยีนี้ช่วยลดการครอบครอง KV cache ต่อ GPU ลงอย่างมาก ซึ่งช่วยเพิ่มจำนวนคำขอที่ GPU สามารถประมวลผลพร้อมกันได้อย่างมีประสิทธิภาพ ข้อได้เปรียบด้านแบนด์วิดท์ของ HBM ซึ่งก่อนหน้านี้ถูกจำกัดโดยความจุของ KV cache จะสามารถถูกปลดปล่อยออกมาได้อย่างเต็มที่มากขึ้น การปรับปรุงประสิทธิภาพการประมวลผลจริงที่ตามมาจะยิ่งช่วยเสริมมูลค่าการติดตั้ง HBM ในเซิร์ฟเวอร์ AI ระดับไฮเอนด์

NAND Flash (Enterprise SSD)

ตรรกะที่ TurboQuant จะส่งผลกระทบต่อ NAND Flash นั้นค่อนข้างเบาบาง ความคาดหวังเชิงบวกของตลาดต่อ NAND ก่อนหน้านี้ถูกสร้างขึ้นจากการประเมินว่าความต้องการพื้นที่จัดเก็บข้อมูลสำหรับเซิร์ฟเวอร์ AI จะระเบิดตัวขึ้น โดย Samsung ได้ปรับราคาล่วงหน้าของ NAND Flash ขึ้นมากกว่า 100% เมื่อเดือนมกราคมที่ผ่านมา

อย่างไรก็ตาม TurboQuant มุ่งเป้าไปที่การบีบอัด KV cache ในระหว่างการประมวลผลเท่านั้น ทำให้ผลกระทบต่อ NAND Flash ที่จำเป็นสำหรับการจัดเก็บและการติดตั้งโมเดลเป็นไปในลักษณะทางอ้อมและมีความล่าช้าอย่างมาก

ตามการคาดการณ์ของ TrendForce ระบุว่า Enterprise SSD จะกลายเป็นเซกเมนต์การใช้งาน NAND Flash ที่ใหญ่ที่สุดในปี 2569 โดยคาดว่าราคาล่วงหน้าของ Client SSD จะเพิ่มขึ้นอย่างน้อย 40% ซึ่งถือเป็นการเพิ่มขึ้นที่มากที่สุดในบรรดาหมวดหมู่ผลิตภัณฑ์ NAND ทั้งหมด

HDD (Hard Disk Drive)

ฮาร์ดดิสก์ไดรฟ์เป็นสื่อจัดเก็บข้อมูลแบบถาวรเช่นกัน และไม่มีส่วนเกี่ยวข้องกับตรรกะการทำงานของ KV caching เลย เทคโนโลยีการเพิ่มประสิทธิภาพการประมวลผลของ TurboQuant จึงส่งผลกระทบต่อความต้องการฮาร์ดดิสก์เป็นศูนย์

ความต้องการ HDD ในปัจจุบันส่วนใหญ่มาจากสถานการณ์ต่าง ๆ เช่น การจัดเก็บข้อมูลที่เข้าถึงไม่บ่อย (cold data storage) และการเก็บถาวร (archiving) ความต้องการเหล่านี้ไม่เกี่ยวข้องกับการปรับปรุงประสิทธิภาพในการประมวลผล AI และตรรกะความต้องการในระยะยาวยังคงมีความเสถียร

TurboQuant ส่งผลกระทบอย่างไรต่ออุตสาหกรรมการจัดเก็บข้อมูลสำหรับ AI?

ภายหลังการเปิดตัวเทคโนโลยี TurboQuant ของ Google หุ้นกลุ่มชิปหน่วยความจำอย่าง Micron Technology ( MU ), Western Digital ( WDC ), SanDisk ( SNDK) รวมถึงหุ้นชิปหน่วยความจำรายอื่น ๆ ต่างปรับตัวลดลงในช่วงสั้น ๆ อย่างไรก็ตาม การตื่นตระหนกขายในครั้งนี้ถือเป็นการคาดการณ์ที่ผิดพลาดของตลาดต่อตรรกะความต้องการในอุตสาหกรรม AI โดยตลาดประเมินว่า "ความต้องการประมวลผล AI (Inference) โดยรวมนั้นคงที่" และการเพิ่มขีดความสามารถของชิปเพียงตัวเดียวจะช่วยลดความต้องการฮาร์ดแวร์โดยรวมลง ซึ่งสมมติฐานนี้ไม่สามารถนำมาใช้ได้เลยกับอุตสาหกรรม AI

รูปแบบในอดีตของอุตสาหกรรมเทคโนโลยีพิสูจน์ให้เห็นมานานแล้วว่า การเพิ่มประสิทธิภาพของทรัพยากรไม่เคยทำให้ความต้องการโดยรวมลดลง ในทางกลับกัน การที่ต้นทุนการใช้งานลดลงอย่างรวดเร็วกลับเป็นตัวเร่งให้เกิดสถานการณ์การใช้งานใหม่ ๆ จำนวนมากซึ่งก่อนหน้านี้ไม่คุ้มค่าในเชิงเศรษฐกิจ ซึ่งท้ายที่สุดแล้วจะเป็นแรงขับเคลื่อนให้ความต้องการโดยรวมเติบโตแบบทวีคูณ

ตัวอย่างเช่น เมื่อประสิทธิภาพการแปลงพลังงานของเซลล์แสงอาทิตย์ (PV) พัฒนาขึ้น ต้นทุนต่อกิโลวัตต์ชั่วโมงก็ลดลง ส่งผลให้ยอดการติดตั้งแผงโซลาร์เซลล์ทั่วโลกพุ่งสูงขึ้นหลายสิบเท่าในช่วงทศวรรษที่ผ่านมา เช่นเดียวกับการอัปเกรดแบนด์วิดท์เครือข่าย 4G และราคาข้อมูลที่ถูกลง ซึ่งทำให้ความต้องการรับส่งข้อมูลสำหรับวิดีโอสั้นและการไลฟ์สตรีมมิ่งพุ่งทะยานขึ้นกว่าร้อยเท่า ตรรกะเดียวกันนี้สามารถนำมาใช้กับ TurboQuant ได้เช่นกัน

ประการแรก ต้นทุนการประมวลผล (Inference) ที่ลดลงอย่างมีนัยสำคัญจะกระตุ้นให้ความต้องการ AI โดยรวมพุ่งสูงขึ้นโดยตรง ซึ่งจะผลักดันให้ปริมาณการใช้หน่วยความจำทั้งหมดเพิ่มขึ้นตามไปด้วย โดย TurboQuant ช่วยลดต้นทุนส่วนเพิ่มของการประมวลผล AI ลงอย่างมาก ทำให้สถานการณ์การใช้งานที่ก่อนหน้านี้ทำไม่ได้เนื่องจากต้นทุนสูง เช่น ระบบบริการลูกค้าอัจฉริยะสำหรับ SME, ระบบแนะนำสินค้า AI ในร้านค้าออฟไลน์, การตรวจสอบคุณภาพด้วย AI สำหรับอุปกรณ์อุตสาหกรรม และโมเดลภาษาขนาดใหญ่บนสมาร์ทโฟนและรถยนต์ สามารถนำไปใช้ในเชิงพาณิชย์ได้จริงในปัจจุบัน

เมื่อถึงเวลานั้น ปริมาณการประมวลผลพร้อมกันจะเติบโตแบบก้าวกระโดด แม้ว่าความสามารถของชิปแต่ละตัวจะเพิ่มขึ้น แต่จำนวน GPU ทั้งหมดและขนาดของหน่วยจัดเก็บข้อมูลที่จำเป็นต้องใช้สนับสนุนก็จะยิ่งมีมากกว่าเดิม

ขณะเดียวกัน การเพิ่มขึ้นของปริมาณงาน (Throughput) จะยิ่งยกระดับความต้องการหน่วยจัดเก็บข้อมูลระดับไฮเอนด์ ซึ่งเป็นประโยชน์ต่อผู้นำในอุตสาหกรรม โดย TurboQuant ช่วยเพิ่มปริมาณงานในการประมวลผลของชิปตัวเดียวถึง 8 เท่า หมายความว่าปริมาณการอ่าน/เขียนข้อมูลระหว่าง GPU และหน่วยความจำต่อหน่วยเวลาก็เพิ่มขึ้นโดยตรงถึง 8 เท่าเช่นกัน สิ่งนี้ส่งผลให้ความต้องการด้านแบนด์วิดท์หน่วยความจำ ความหน่วง และความเสถียรเพิ่มสูงขึ้น ซึ่งหน่วยความจำ DDR4 ทั่วไปไม่สามารถรองรับได้ สถานการณ์นี้จะเร่งการเปลี่ยนผ่านจาก DDR4 ไปสู่ DDR5 โดยตรง พร้อมทั้งเพิ่มการเข้าถึงเทคโนโลยี HBM ในเซิร์ฟเวอร์ AI ซึ่งท้ายที่สุดแล้วจะเป็นประโยชน์ต่อผู้ผลิตชั้นนำในกลุ่มหน่วยจัดเก็บข้อมูลระดับไฮเอนด์และแบนด์วิดท์สูง

ในระยะยาว TurboQuant จะเพียงแค่เปลี่ยนโครงสร้างความต้องการหน่วยจัดเก็บข้อมูล โดยไม่ส่งผลกระทบต่อแนวโน้มในระดับมหภาคของความต้องการโดยรวมที่กำลังพุ่งสูงขึ้น

ความต้องการหน่วยจัดเก็บข้อมูลสำหรับเซิร์ฟเวอร์ AI นั้นสูงกว่าเซิร์ฟเวอร์ทั่วไปถึง 8 ถึง 10 เท่า และเมื่อโมเดล AI ขนาดใหญ่ระดับโลกเปลี่ยนผ่านจากช่วงการฝึกฝน (Training) ไปสู่การประยุกต์ใช้งานในวงกว้าง ความต้องการชิปหน่วยความจำจึงเติบโตแบบเรขาคณิต และกลายเป็นแรงขับเคลื่อนหลักในการเติบโตของความต้องการในอุตสาหกรรมหน่วยจัดเก็บข้อมูล

ในขณะเดียวกัน ภาวะอุปทานตึงตัวของชิปหน่วยความจำยังคงดำเนินต่อไป โดยสถาบันที่มีชื่อเสียงหลายแห่งคาดการณ์ว่าการขาดแคลนจะยืดเยื้อ แม้แต่ Nomura Securities ก็ได้ปรับเพิ่มคาดการณ์ราคาสำหรับ DRAM และ NAND flash สำหรับไตรมาสที่สองของปี 2026 ขึ้นอย่างมีนัยสำคัญ โดยคาดว่าจะมีการพุ่งขึ้นของราคาอย่างรุนแรง

ปัจจุบันอุตสาหกรรมมีความเห็นพ้องต้องกันว่า การเติบโตของความต้องการหน่วยจัดเก็บข้อมูลที่ขับเคลื่อนโดย AI นั้นเป็นสิ่งที่ไม่อาจย้อนกลับได้ คาดว่าการเติบโตที่แข็งแกร่งนี้จะคงอยู่ต่อไปอีกอย่างน้อย 3 ถึง 5 ปี และคอขวดในห่วงโซ่อุตสาหกรรมกำลังค่อย ๆ เปลี่ยนจาก GPU ไปสู่หน่วยจัดเก็บข้อมูล การบรรจุภัณฑ์ (Packaging) และแบนด์วิดท์เครือข่าย

แม้ว่าเทคโนโลยีนี้จะถูกนำมาใช้ในเชิงพาณิชย์ในวงกว้างในอีก 1 ถึง 2 ปีข้างหน้า แต่อย่างมากที่สุดก็จะส่งผลเพียงการปรับเปลี่ยนโครงสร้างการกำหนดค่าหน่วยความจำต่อชิปในด้านการประมวลผล (Inference) เท่านั้น โดยจะไม่เปลี่ยนแปลงตรรกะหลักของ "การขยายตัวอย่างต่อเนื่องของเซิร์ฟเวอร์ AI และการเติบโตอย่างก้าวกระโดดของความต้องการหน่วยจัดเก็บข้อมูล AI โดยรวม" และอาจทำหน้าที่เป็นตัวเร่งให้แนวโน้มนี้รวดเร็วยิ่งขึ้นด้วยซ้ำ

TurboQuant กำลังเผชิญกับความท้าทายประการใดบ้าง?

แม้ว่า TurboQuant จะแสดงให้เห็นถึงข้อได้เปรียบที่ก้าวล้ำในด้านการบีบอัดหน่วยความจำและประสิทธิภาพในการประมวลผล (inference) แต่เทคโนโลยีนี้ยังคงเผชิญกับความท้าทายในทางปฏิบัติที่หลากหลายและข้อขัดแย้งเชิงพัฒนาการที่อาจเกิดขึ้น ตั้งแต่การนำไปใช้ในเชิงเทคนิคไปจนถึงการปรับตัวในระดับอุตสาหกรรม ดังนั้นจึงกล่าวได้ว่าเทคโนโลยีนี้ยังไม่ใช่สิ่งที่ไร้ที่ติ

การรักษาสมดุลระหว่างความแม่นยำในการบีบอัดและประสิทธิภาพของโมเดลถือเป็นความท้าทายหลักที่ไม่อาจหลีกเลี่ยงได้ โดยในปัจจุบัน ระดับ 3-bit ได้รับการยืนยันว่าเป็นจุดสมดุลที่เหมาะสมที่สุดระหว่างอัตราส่วนการบีบอัดและประสิทธิภาพ อย่างไรก็ตาม หากมีการลดระดับลงเหลือ 2-bit อย่างรุนแรงเพื่อมุ่งหวังการบีบอัดขั้นสูงสุด ความแม่นยำระดับ top-1 ของโมเดลจะดิ่งลงเหลือเพียง 66% ซึ่งส่งผลให้เกิดความคลาดเคลื่อนทางตรรกะอย่างชัดเจน หรือแม้แต่การที่ AI แสดงผลลัพธ์ที่ไม่เกี่ยวข้องออกมา การเสื่อมถอยของประสิทธิภาพในภารกิจหลักนี้จะหักล้างผลประโยชน์ด้านประสิทธิภาพที่ได้จากการบีบอัดโดยตรง ซึ่งหมายความว่าความสามารถในการบีบอัดของ TurboQuant นั้นไม่สามารถขยายขนาดได้อย่างไร้ขีดจำกัด และจำเป็นต้องหาช่วงการปรับใช้ที่แม่นยำระหว่างการประหยัดหน่วยความจำและคุณภาพของผลลัพธ์

ประสิทธิภาพการประมวลผลที่ TurboQuant กล่าวอ้างว่า "เร่งความเร็วได้สูงสุดถึง 8 เท่า" นั้น สามารถเกิดขึ้นได้จริงเฉพาะบนสถาปัตยกรรม GPU ระดับบนสุดอย่าง NVIDIA H100 เท่านั้น ซึ่งในปัจจุบันฮาร์ดแวร์เหล่านี้มีราคาสูงและขาดแคลน ขณะที่การปรับปรุงประสิทธิภาพสำหรับพีซีระดับผู้บริโภค อุปกรณ์เคลื่อนที่ และเซิร์ฟเวอร์ระดับล่างถึงระดับกลางนั้นยังต้องใช้ระยะเวลาในการพัฒนานานกว่า ในระยะสั้น ข้อจำกัดนี้จะขัดขวางไม่ให้ผลประโยชน์ด้านประสิทธิภาพของเทคโนโลยีเข้าถึงทุกสถานการณ์การประมวลผล AI โดยอุปสรรคด้านฮาร์ดแวร์ถือเป็นปัจจัยสำคัญที่ขัดขวางการแพร่หลายอย่างรวดเร็ว

ขณะเดียวกัน ความสามารถของ TurboQuant ในการบีบอัดหน่วยความจำสำหรับการประมวลผล AI ให้เหลือเพียง 1 ใน 6 ของระดับเดิม ส่งผลให้ผู้ให้บริการคลาวด์และศูนย์ข้อมูลปรับลดคาดการณ์การจัดซื้อหน่วยความจำระดับไฮเอนด์ลงอย่างมาก ความกังวลของตลาดที่ว่าการเติบโตของผู้ผลิตหน่วยความจำอาจชะลอตัวลงตามไปด้วยนั้น ได้ส่งผลให้ราคาหุ้นของบริษัทยักษ์ใหญ่ด้านชิปจัดเก็บข้อมูลอย่าง Micron เกิดความผันผวนอย่างรุนแรงในระยะสั้น แม้ว่าปฏิกิริยาที่ขับเคลื่อนด้วยอารมณ์เหล่านี้อาจดูเกินจริงไปบ้าง แต่สิ่งนี้สะท้อนให้เห็นถึงแรงสั่นสะเทือนต่อพลวัตของอุปสงค์และอุปทานในอุตสาหกรรมที่มีอยู่เดิมในช่วงเริ่มต้นของการนำเทคโนโลยีใหม่มาใช้

สิ่งที่น่าสังเกตมากที่สุดคือผลกระทบที่อาจเกิดขึ้นจากทฤษฎีความย้อนแย้งของเจวอนส์ (Jevons Paradox)

TurboQuant ช่วยลดภาระหน่วยความจำและต้นทุนการประมวลผลของแต่ละโมเดล ซึ่งดูเหมือนว่าจะช่วยลดความต้องการหน่วยความจำลง อย่างไรก็ตาม เมื่อต้นทุนส่วนเพิ่มของแอปพลิเคชัน AI ลดลงอย่างมีนัยสำคัญ นักพัฒนามีแนวโน้มที่จะพัฒนาโมเดลที่ซับซ้อนยิ่งขึ้น ใช้ชุดข้อมูลการฝึกฝนที่ใหญ่ขึ้น และติดตั้งใช้งาน AI ในสถานการณ์ที่หลากหลายขึ้น ซึ่งในท้ายที่สุดอาจกระตุ้นให้เกิดการพุ่งตัวขึ้นอย่างรุนแรงของความต้องการหน่วยความจำทั่วโลก สิ่งที่เรียกว่า "การบรรเทาภาระหน่วยความจำ" อาจกลับกลายเป็นตัวเร่งให้ความต้องการขยายตัวแทน ความย้อนแย้งนี้ทำให้ผลกระทบระยะยาวของ TurboQuant ต่ออุตสาหกรรมอุปกรณ์จัดเก็บข้อมูลมีความไม่แน่นอนสูงมาก

บทความแนะนำ

ความคิดเห็น (0)

คลิกปุ่ม $ ป้อนสัญลักษณ์ และเลือกเพื่อเชื่อมโยงหุ้น, กองทุน ETF หรือสัญลักษณ์หลักทรัพย์อื่น ๆ