구글 터보퀀트(TurboQuant) 압축 알고리즘이란 무엇인가? AI 스토리지 칩 산업에 미치는 영향은?

Google의 TurboQuant 벡터 압축 알고리즘은 AI 추론 시 메모리 사용 효율을 높여 KV 캐시 문제를 해결한다. 이 기술은 벡터를 극좌표로 변환하고 QJL을 사용해 정밀도 손실 없이 데이터를 약 3비트로 압축, 최대 6배의 압축률과 8배의 연산 효율 향상을 달성한다.

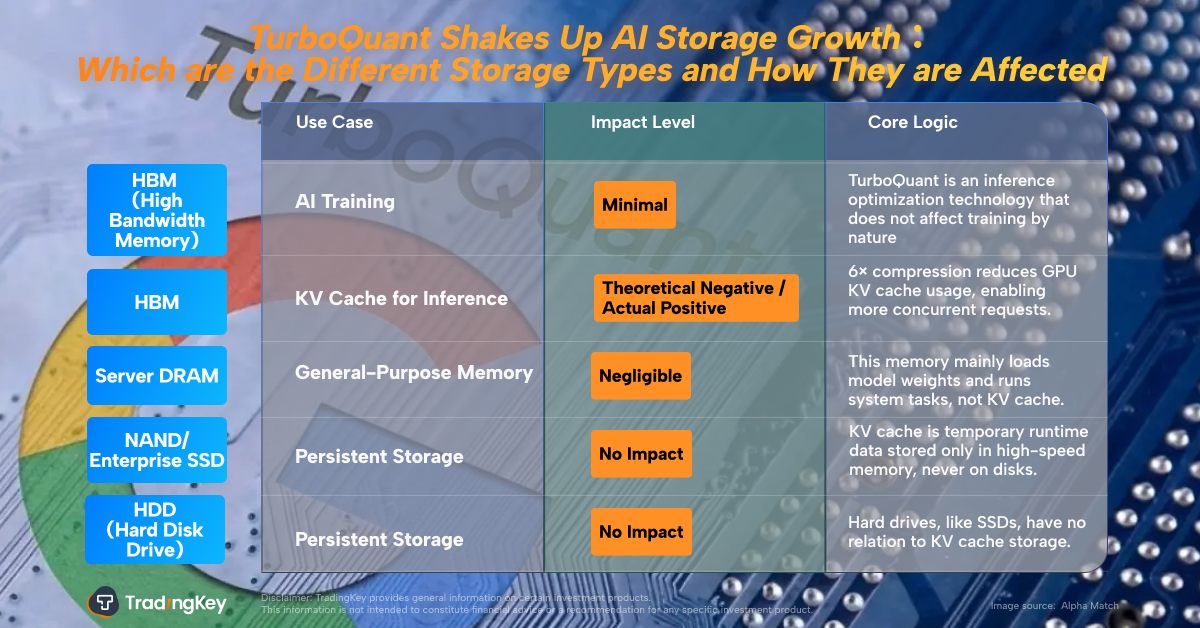

TurboQuant는 DRAM 수요 증가율을 둔화시킬 수 있으나, HBM에는 긍정적 영향을 미쳐 GPU당 동시 요청 수를 늘릴 것으로 예상된다. 낸드 플래시와 HDD에는 영향이 미미할 전망이다.

시장은 TurboQuant 도입으로 인한 전체 AI 수요 감소를 우려했으나, 이는 잘못된 가정이다. 기술 발전은 오히려 AI 애플리케이션 비용을 낮춰 새로운 시나리오를 촉발하고 총 수요를 폭발적으로 증가시킬 것이다. 이는 GPU, 스토리지, 네트워크 대역폭에 대한 수요를 더욱 높여 하이엔드 스토리지 제조업체에 수혜를 줄 것으로 보인다.

다만, 극한 압축 시 정확도 저하, 고가 GPU 중심의 초기 확산 장벽, 잠재적 제번스의 역설(수요 증가) 등 과제도 존재한다.

TradingKey - 구글 ( GOOGL) ( GOOG )의 TurboQuant 벡터 압축 알고리즘 도입은 마치 정교하게 던져진 돌처럼 AI 메모리 칩 업계 전반에 파장을 일으키고 있습니다.

이 새로운 벡터 압축 알고리즘은 AI 추론 단계에서의 메모리 사용 효율성에 특화되어 최적화되었으며, 특히 높은 키-값 캐시(KV Cache) 점유 문제를 해결하는 데 탁월합니다. 이는 AI 모델이 더 적은 메모리 소비로 더 많은 데이터를 처리할 수 있음을 의미하는 동시에, 업계에 새로운 과제를 제시하고 있습니다.

그렇다면 TurboQuant는 정확히 무엇일까요? 어떤 독보적인 기술적 장점을 보유하고 있으며, AI 메모리 산업에는 어떤 영향을 미칠까요?

TurboQuant란 무엇인가?

TurboQuant는 Google Research가 2026년 3월 공식 발표한 새로운 벡터 압축 알고리즘으로, 거대언어모델(LLM) 및 벡터 검색 엔진의 추론 단계 내 핵심 고충인 키-값 캐시(KV Cache)의 과도한 메모리 소모를 해결하는 것을 목표로 한다. 기술적 세부 사항은 4월 23일부터 27일까지 열리는 ICLR 2026(국제 학습 표현 컨퍼런스)에서 학술 논문으로 정식 발표 및 동료 검토를 거칠 예정이다.

거대언어모델의 추론 과정에서 KV 캐시는 모델의 "임시 메모" 역할을 하며, 모든 대화 회차와 입력 텍스트 세그먼트를 고차원 벡터로 변환하여 후속 추론 단계를 위한 문맥을 제공하기 위해 일시적으로 저장한다. 추론 정밀도를 보장하기 위해 기존 솔루션은 일반적으로 벡터 데이터를 16비트 부동 소수점(FP16/BF16) 형식으로 저장한다. 그러나 대화 길이가 길어지거나 텍스트 규모가 확장됨에 따라 KV 캐시는 "데이터 블랙홀"처럼 GPU 고대역폭 메모리를 소모하며, 이는 추론 속도를 늦출 뿐만 아니라 컴퓨팅 비용을 크게 부풀려 거대 모델 배포의 핵심 병목 현상이 되고 있다.

업계의 합의에 따르면 현재 거대 모델의 병목 현상은 파라미터 수가 아니라 메모리 용량이다. 문맥이 길어질수록 KV 캐시의 메모리 점유율이 커지며, 이는 결국 모델 파라미터보다 먼저 하드웨어 한계에 도달하게 된다. 이는 긴 텍스트 생성 및 긴 문서 이해와 같은 작업에서 공통적으로 나타나는 고충이다.

TurboQuant의 획기적인 돌파구는 이러한 고충을 직접적으로 해결한다.

TurboQuant는 두 가지 기반 기술의 시너지를 통해 추가적인 메모리 오버헤드 없이, 그리고 추론 정밀도에 거의 영향을 미치지 않으면서 극한의 KV 캐시 압축을 달성한다.

첫 번째 단계는 1차 압축을 위해 PolarQuant를 사용하며, AI 모델 벡터를 극좌표로 변환함으로써 기존의 데카르트 좌표(XYZ) 인코딩 로직을 타파한다. 예를 들어, 기존 인코딩이 "동쪽으로 3블록, 북쪽으로 4블록 이동"이라고 말하는 것과 같다면, 극좌표는 "37도 각도로 5블록 이동"으로 설명하여 벡터를 "반지름(핵심 데이터 강도) + 방향(데이터 의미론)"으로 단순화한다. 이 변환은 벡터를 고정된 경계를 가진 "원형 그리드"에 매핑하여 기존 방식에서 요구되던 비용이 많이 드는 데이터 정규화 단계를 제거하고, 중복 저장을 근본적으로 차단하여 대부분의 메모리 절감을 실현한다.

두 번째 단계는 잔류 오차를 처리하기 위해 QJL(Quantized Johnson-Lindenstrauss) 기술을 활용한다. PolarQuant가 효율적인 압축을 달성함에도 불구하고 약간의 정밀도 편차가 발생할 수 있다. QJL은 단 1비트의 연산 능력만을 사용하여 각 벡터에 +1 또는 -1 보정 마커를 추가하며, 벡터 간 관계를 완전히 보존하면서 이러한 오차를 부드럽게 완화하는 "수학적 오류 수정 장치" 역할을 한다. 이를 통해 모델은 신경망이 데이터 중요도를 판단하는 핵심 과정인 정밀한 어텐션 점수를 계산할 수 있으며, 전체 보정 단계에서 메모리 오버헤드는 전혀 발생하지 않는다.

터보퀀트, 성과 지표 부문 선두 기록

구글의 TurboQuant는 32비트 또는 16비트 벡터 데이터를 약 3비트로 압축하며 획기적인 압축 및 효율성 성능을 달성했다. 최대 6배에 달하는 압축률을 통해 거대 모델 KV 캐시(KV Cache)의 메모리 점유 공간을 원래 수준의 6분의 1로 직접 줄일 수 있다.

하드웨어 벤치마크에서 이 알고리즘은 NVIDIA H100과 같은 장치에서 상당한 속도 우위를 입증했으며, 연산 효율은 최대 8배까지 향상되었다.

결정적으로, 전 과정에서 "정밀도 손실 제로(zero precision loss)"를 달성하기 위한 사전 학습이나 미세 조정이 필요하지 않다. 질의응답, 코드 생성, 장문 요약과 같은 작업 전반에서 성능이 거의 유지되며, 특정 데이터셋에 대한 파라미터 튜닝 없이 다양한 거대 모델 추론 시나리오에 즉각적인 적용이 가능하다.

벡터 검색 테스트에서도 TurboQuant는 기존의 제품 양자화 방식을 능가하는 성능을 보였다. 재현율을 유지하면서 인덱싱 시간을 거의 제로에 가깝게 줄일 수 있으며, 이는 의미론적 벡터 매칭에 의존하는 현대적 검색 엔진에 매우 중요하다. 현재 주요 검색 엔진은 정밀한 의미 검색을 위해 수십억 개의 고차원 벡터를 사용하고 있으며, TurboQuant의 높은 압축률은 저장 비용을 직접 낮추는 동시에 응답 속도를 높여 대규모 의미 검색을 위한 새로운 최적화 공간을 마련한다.

구현 관점에서 TurboQuant는 AI 모델의 운영 비용과 메모리 요구 사항을 직접적으로 낮추어 스마트폰처럼 하드웨어가 제한된 모바일 기기에서도 고품질의 로컬 출력을 가능하게 한다. 아울러 확보된 메모리 공간을 통해 더 복잡한 모델의 구동이 가능해짐에 따라, 향후 "비용 절감과 모델 업그레이드"가 동시에 이루어지는 구현 트렌드가 나타날 것으로 예상된다.

터보퀀트가 메모리 반도체에 미치는 영향

현재 AI 하드웨어 시장은 "고가격·공급 부족"이라는 극심한 곤경에 처해 있으며, 고대역폭·대용량 스토리지 자원이 AI의 대규모 구현을 제약하는 핵심 병목 지점이 되었습니다. 거대 모델의 학습 및 추론에 필요한 초고대역폭 수요를 충족하기 위해 AI 서버의 HBM(High Bandwidth Memory) 의존도가 심화되었고, 이는 시장 가격을 직접적으로 끌어올려 글로벌 공급 부족 현상이 지속되는 결과를 낳았습니다.

거대 모델의 운용을 지원하기 위해 기업들은 "하드웨어 병렬 적재"라는 무차별적인 방식을 채택할 수밖에 없었고, 이에 따라 AI 도입 및 운영 비용은 지나치게 높은 수준을 유지하고 있습니다. 다만, Google의 TurboQuant 기술 등장은 다양한 메모리 칩의 수요 논리를 재편할 가능성이 있습니다.

서버용 DRAM (DDR5)

TurboQuant의 최적화 대상은 AI 추론 시나리오에서 메모리 소모가 가장 심한 KV 캐시와 벡터 인덱스 모듈에 정밀하게 맞춰져 있습니다. 해당 기술이 대규모로 도입되면 단일 서버에서 "더 적은 메모리로 더 많은 모델을 호스팅"할 수 있는 능력을 갖추게 됩니다. 이에 따라 DRAM 용량 수요 증가율이 둔화될 수 있다는 시장의 우려가 제기되었으며, 이는 최근 시장 심리 변화의 직접적인 원인이 되었습니다.

그럼에도 불구하고 실제 수급 환경의 지지력은 여전히 강력합니다. TrendForce의 2026년 1분기 산업 보고서에 따르면, 수급 격차가 계속 확대됨에 따라 표준형 DRAM의 고정거래가격은 전분기 대비 55%~60% 상승할 것으로 전망됩니다.

HBM (High Bandwidth Memory)

AI 학습 시나리오의 핵심 저장 매체인 HBM은 TurboQuant의 영향으로부터 사실상 자유롭습니다. TurboQuant는 본질적으로 추론 최적화 기술로, 설계 단계부터 학습용 메모리 로직은 포함하지 않았기 때문입니다. AI 학습에서 HBM의 고대역폭과 대용량에 대한 수요는 계속해서 증가하고 있으며, 타이트한 수급 상황도 변함없이 유지될 것입니다.

추론 시나리오에서 HBM은 오히려 TurboQuant를 통해 추가적인 이득을 얻을 수 있습니다. 6배의 압축률을 자랑하는 이 기술은 GPU당 KV 캐시 점유율을 대폭 낮춰 GPU가 처리할 수 있는 동시 요청 수를 실질적으로 늘려줍니다. 기존에 KV 캐시 용량의 한계로 제약받았던 HBM의 대역폭 강점이 이제 더 충분히 발휘될 수 있게 된 것입니다. 이로 인한 실제 추론 효율의 향상은 하이엔드 AI 서버 내 HBM의 도입 가치를 더욱 강화할 전망입니다.

낸드 플래시 (기업용 SSD)

TurboQuant가 낸드 플래시에 미치는 영향력에 대한 논거는 부족합니다. 과거 낸드에 대한 낙관적인 시장 기대는 AI 서버의 스토리지 수요가 폭발할 것이라는 판단에 근거한 것이었으며, 삼성은 지난 1월 낸드 플래시 고정거래가격을 100% 이상 인상한 바 있습니다.

하지만 TurboQuant는 추론 과정 중의 KV 캐시 압축만을 대상으로 하기 때문에, 모델 저장 및 배포에 필요한 낸드 플래시에 미치는 영향은 매우 간접적이고 후행적입니다.

TrendForce 전망에 따르면 2026년 기업용 SSD는 낸드 플래시의 최대 응용 분야가 될 것이며, 클라이언트 SSD 고정거래가격은 모든 낸드 제품군 중 가장 큰 폭인 최소 40% 이상 상승할 것으로 예상됩니다.

HDD (하드 디스크 드라이브)

하드 디스크 드라이브 또한 지속성 저장 매체이며 KV 캐싱의 운용 로직과는 전혀 무관합니다. TurboQuant의 추론 최적화 기술은 해당 수요에 아무런 영향을 미치지 않습니다.

현재 HDD에 대한 수요는 주로 콜드 데이터 스토리지 및 아카이빙과 같은 시나리오에서 발생합니다. 이러한 요구 사항은 AI 추론 효율 향상과는 관련이 없으며, 장기적인 수요 논리는 안정적으로 유지되고 있습니다.

TurboQuant가 AI 스토리지 산업에 미치는 영향은 무엇인가?

Google의 TurboQuant 기술 발표 이후 Micron Technology( MU ), Western Digital ( WDC ), SanDisk ( SNDK) 및 기타 메모리 칩 관련 주들이 단기적인 하락세를 보였다. 그러나 이러한 패닉 셀링은 본질적으로 AI 산업 내 수요 논리에 대한 시장의 오판에 기인한다. 즉, "AI 추론을 위한 전체 동시 수요가 고정되어 있다"고 가정하고 단일 카드의 용량을 늘리면 전체 하드웨어 수요가 감소할 것으로 본 것인데, 이러한 전제는 AI 산업에서 전혀 타당하지 않다.

기술 산업의 역사적 패턴은 자원 효율성의 개선이 전체 수요를 결코 감소시키지 않는다는 점을 오랫동안 증명해 왔다. 오히려 사용 비용을 급락시킴으로써 과거에는 경제성이 없었던 수많은 새로운 시나리오를 촉발하고, 궁극적으로 전체 수요의 기하급수적인 성장을 견인한다.

예컨대 태양광 전지의 변환 효율이 개선되면서 킬로와트시당 비용이 하락했고, 이는 10년 동안 전 세계 태양광 설치량의 수십 배 급증으로 이어졌다. 마찬가지로 4G 네트워크 대역폭의 업그레이드와 데이터 가격 인하는 숏폼 영상 및 라이브 스트리밍의 트래픽 수요를 100배 이상 폭증시켰다. 이와 동일한 논리가 TurboQuant에도 적용된다.

첫째, 추론 비용의 대폭적인 하락은 AI 전체 수요의 폭발을 직접적으로 유발하여 총 메모리 사용량의 급증을 이끌 것이다. TurboQuant는 AI 추론의 한계 비용을 획기적으로 낮춰, 중소기업용 지능형 고객 서비스, 오프라인 매장의 AI 쇼핑 가이드, 산업 장비의 로컬 AI 품질 검사, 스마트폰 및 자동차용 온디바이스 거대언어모델 등 과거 높은 비용으로 인해 불가능했던 시나리오들을 상업적으로 실현 가능하게 만든다.

그때가 되면 동시 추론량은 기하급수적인 성장을 경험하게 될 것이다. 카드당 용량이 늘어나더라도 필요한 전체 GPU 수와 이를 지원하는 스토리지 규모는 이전보다 더 커질 수밖에 없다.

동시에 처리량(throughput)의 증가는 사실상 하이엔드 스토리지에 대한 요구 사양을 높여 업계 선두 기업들에 이익이 될 것이다. TurboQuant는 단일 카드 추론 처리량을 8배 향상시키는데, 이는 단위 시간당 GPU와 메모리 사이에서 읽고 쓰는 데이터 양이 직접적으로 8배 늘어났음을 의미한다. 이는 메모리 대역폭, 지연 시간 및 안정성에 대해 일반적인 DDR4로는 감당할 수 없는 더 높은 요구 조건을 부과한다. 이는 DDR4에서 DDR5로의 전환을 직접적으로 가속화하는 한편 AI 서버 내 HBM 침투율을 높여, 궁극적으로 하이엔드 및 고대역폭 스토리지 분야의 선두 제조업체들에 수혜를 줄 것이다.

장기적으로 TurboQuant는 스토리지 수요 구조를 변화시킬 뿐, 전체 수요 폭발이라는 거시적 추세는 흔들지 못할 것이다.

AI 서버의 스토리지 수요는 기존 서버의 8~10배에 달한다. 전 세계 AI 거대 모델이 학습 단계에서 대규모 응용 단계로 전환됨에 따라 메모리 칩 수요는 기하급수적으로 늘어나고 있으며, 이는 스토리지 산업 수요 성장의 핵심 동력이 되고 있다.

한편 메모리 칩의 타이트한 수급 상황이 지속되고 있으며, 여러 권위 있는 기관들은 이러한 부족 현상이 계속될 것으로 예측하고 있다. 노무라 증권은 2026년 2분기 DRAM 및 낸드 플래시 메모리의 가격 상승 전망치를 대폭 상향 조정하며 '자릿수가 다른(magnitude-level)' 수준의 급등을 예상하기도 했다.

AI에 의한 스토리지 수요 성장이 되돌릴 수 없는 흐름이라는 점에 대해 업계의 공감대가 형성되었다. 이러한 경직적 성장은 최소 3~5년 동안 지속될 것으로 예상되며, 산업 체인의 병목 현상은 점차 GPU에서 스토리지, 패키징 및 네트워크 대역폭으로 이동하고 있다.

향후 1~2년 내에 이 기술이 대규모로 상용화되더라도, 이는 추론 측면에서 카드당 메모리 구성 구조를 미세 조정하는 결과에 그칠 것이다. 이는 "AI 서버 침투율의 지속적인 향상과 전체 AI 스토리지 수요의 폭발적 성장"이라는 핵심 논리를 바꾸지 못하며, 오히려 이러한 추세를 가속화하는 촉매제 역할을 할 수도 있다.

TurboQuant가 직면한 과제는 무엇인가?

TurboQuant는 메모리 압축 및 추론 효율성에서 획기적인 이점을 보여주지만, 기술적 구현부터 산업적 적응에 이르기까지 여러 실질적인 과제와 잠재적인 발전의 역설에 직면해 있어 결함이 없는 것은 아니다.

압축 정밀도와 모델 성능 사이의 균형은 피할 수 없는 핵심 과제다. 현재 3비트가 압축률과 성능 사이의 최적 균형점으로 검증되었다. 하지만 극한의 압축을 위해 공격적으로 2비트로 낮추면 모델의 Top-1 정확도는 66%로 급락하며, 명백한 논리적 편차나 무관한 AI 출력을 초래할 수 있다. 핵심 작업 성능의 저하는 압축을 통한 효율성 이득을 직접적으로 상쇄하므로, TurboQuant의 압축 능력이 무한히 확장될 수는 없으며 메모리 절약과 출력 품질 사이에서 정밀한 적응 범위를 찾아야 함을 의미한다.

현재 홍보되는 TurboQuant의 '최대 8배 가속'은 NVIDIA H100과 같은 최상위 GPU 아키텍처에서만 온전히 실현될 수 있다. 해당 하드웨어는 현재 고가이며 공급이 부족한 반면, 소비자용 PC, 모바일 기기, 중저가 서버에 대한 최적화에는 더 긴 주기가 필요할 것이다. 단기적으로는 이러한 하드웨어 장벽이 빠른 대중화의 상당한 걸림돌이 되어 기술의 효율성 배당이 모든 AI 추론 시나리오에 도달하는 것을 방해하고 있다.

한편, AI 추론 메모리를 원래 수준의 6분의 1로 압축하는 TurboQuant의 능력으로 인해 클라우드 제공업체와 데이터 센터는 하이엔드 메모리 조달 전망치를 대폭 하향 조정했다. 이에 따른 메모리 제조사의 성장 둔화 우려로 마이크론(Micron)과 같은 저장 칩 거대 기업의 주가는 단기적으로 급등락했다. 이러한 정서적 반응은 다소 과장된 측면이 있을 수 있으나, 신기술 도입 초기 단계에서 기존 산업 수급 역학에 가해진 충격을 반영한다.

가장 주목할 점은 잠재적인 제번스의 역설(Jevons Paradox) 효과다.

TurboQuant는 개별 모델의 메모리 부담과 추론 비용을 낮추어 겉으로는 메모리 수요를 줄이는 것처럼 보인다. 그러나 AI 애플리케이션의 한계 비용이 크게 떨어짐에 따라 개발자들은 더 복잡한 모델을 개발하고 더 큰 훈련 데이터셋을 수용하며 더 많은 시나리오에 AI를 배포하는 경향이 있다. 이는 궁극적으로 전 세계 메모리 총수요의 폭발을 촉발할 수 있으며, 소위 '메모리 완화'가 오히려 수요 확대의 촉매제가 될 수 있다. 이러한 역설은 저장장치 산업에 대한 TurboQuant의 장기적인 영향을 매우 불확실하게 만든다.

추천 기사

코멘트 (0)

$ 버튼을 클릭하고, 종목 코드를 입력한 후 주식, ETF 또는 기타 티커를 연결합니다.