亚马逊利用 Cerebras 的晶圆级芯片来加速 AWS 上的 AI 模型

亚马逊网络服务公司周五表示,将在其数据中心部署来自 Cerebras 的处理器,这是一项为期多年的合作计划,重点是人工智能推理。.

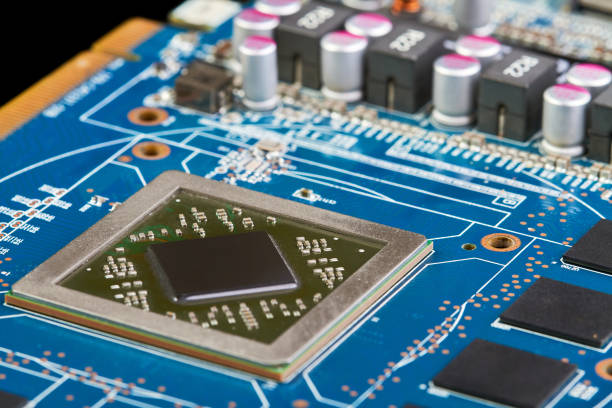

这项交易为亚马逊提供了一种新途径,可以加快人工智能模型响应提示、编写代码和处理实时用户请求的速度。AWS 表示,它将使用 Cerebras 的技术,包括晶圆级引擎,来进行推理任务。.

双方并未透露具体的财务条款。该项目计划在AWS数据中心内的Amazon Bedrock平台上进行部署,这意味着此次合作将直接融入亚马逊的核心人工智能产品之一。.

AWS 表示,该系统将结合 Amazon Trainium 服务器、Cerebras CS-3 系统和 Amazon 的 Elastic Fabric Adapter 网络。.

今年晚些时候,AWS 还计划在 Cerebras 硬件上提供领先的开源大型语言模型和 Amazon Nova。AWS 计算和机器学习服务副dent David Brown 表示,速度仍然是人工智能推理的一个主要问题,尤其是在实时编码辅助和交互式应用程序方面。.

David 表示:“推理是人工智能为客户带来真正价值的地方,但速度仍然是实时编码辅助和交互式应用程序等高要求工作负载的关键瓶颈。”

亚马逊将预填充和解码功能分别放在不同的芯片上。

AWS 表示,该设计采用了一种名为推理分解的方法。这意味着将 AI 推理过程拆分为两部分。第一部分是提示处理,也称为预填充。第二部分是输出生成,也称为解码。.

AWS 表示,这两个作业的运行方式截然不同。预填充是并行的,计算量大,需要中等内存带宽。解码是串行的,计算量较小,但对内存带宽的dent 更高。在这些情况下,解码也耗时更长,因为每个输出标记都必须逐个生成。.

因此,AWS 为每个阶段分配了不同的硬件。Trainium 将负责预填充,Cerebras CS-3 将负责解码。.

AWS 表示,低延迟、高带宽的 EFA 网络将连接两端,使系统能够作为一个整体服务运行,而每个处理器则专注于单独的任务。.

David 说:“我们利用 Cerebras 构建的方案解决了这个问题:通过将推理工作负载分配到 Trainium 和 CS-3 上,并使用亚马逊的 Elastic Fabric Adapter 将它们连接起来,每个系统都能发挥其最擅长的作用。最终的推理速度将比现有方案快一个数量级,性能也将更高。”

AWS 还表示,该服务将在 AWS Nitro 系统上运行,该系统是其云基础设施的基础层。.

这意味着 Cerebras CS-3 系统和 Trainium 实例有望以与 AWS 客户已使用的相同的安全性、隔离性和一致性运行。.

亚马逊加大力度推广 Trainium,英伟达面临另一威胁

此次公告也为亚马逊提供了一个新的契机,使其能够利用 Trainium 芯片与英伟达、AMD 和其他大型芯片公司的芯片展开竞争。AWS 将 Trainium 描述为其自主研发的 AI 芯片,旨在实现训练和推理过程中可扩展的性能和成本效益。

AWS表示,已有两家大型人工智能实验室承诺采用Trainium。Anthropic已指定AWS为其主要训练合作伙伴,并使用Trainium进行模型训练和部署。OpenAI将通过AWS基础设施使用2吉瓦的Trainium容量,用于有状态运行时环境、前沿模型和其他高级工作负载。.

AWS 还表示,Trainium3 自发布以来得到了tron应用,各行各业的客户都投入了大量资源。.

Cerebras 负责处理解码部分。AWS 表示,CS-3 专用于解码加速,这使其能够处理更多快速输出的令牌。Cerebras 称,CS-3 是世界上速度最快的 AI 推理系统,其内存带宽比最快的 GPU 高出数千倍。.

该公司表示,推理模型目前在推理工作中占比越来越大,并且在解决问题的过程中,每次请求都会生成更多令牌。Cerebras 还表示,OpenAI、Cognition、Mistral 等公司都在使用其系统来处理高负载任务,尤其是智能体编码。.

Cerebras Systems 的创始人兼首席执行官 Andrew Feldman 表示:“与 AWS 合作构建分散式推理解决方案,将为全球客户群带来最快的推理速度。”

Andrew补充道:“世界各地的企业都将能够从其现有AWS环境中极快的推理速度中受益。”

该交易给英伟达带来了更大的压力,英伟达在去年 12 月与 Groq 签署了一项价值 200 亿美元的许可协议,并计划下周推出一款使用 Groq 技术的新推理系统。.

你的钱在银行手里,你却只能拿到残羹剩饭。观看我们的免费视频,了解如何成为自己的银行