揭秘全球首场人工智能战争:目标选择错误、虚假信息和问责机制漏洞

在美国和以色列对伊朗发动空袭的第一天,伊朗南部城镇米纳布的一所学校遭到炸弹袭击,造成包括学生在内的175多人死亡。华盛顿和特拉维夫方面均未就此事作出解释也无人认领责任。一个问题不断涌现:是人工智能系统误击了目标吗?

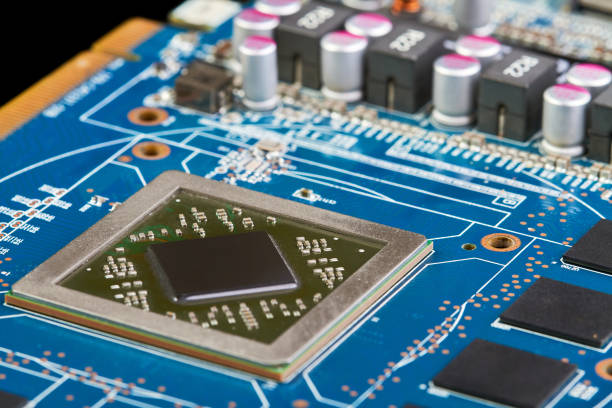

在最初的24小时内,美军打击了约1000个目标,平均每小时约借助Maven智能系统,20人就能完成过去需要2000人团队才能完成的工作。到2024年底,美国已将大型语言模型(与消费级人工智能聊天机器人背后的软件类型相同)集成到Maven系统中。这是最早将该技术应用于

美国军方表示仍在调查米纳布袭击事件。但尚未说明是否参与向该建筑物发射导弹,以及参与程度如何

《纽约时报》早前报道称,该系统可能使用的是旧数据。驻外记者dent·洛夫拉克在X网站上撰文指出,此次袭击可能“基于十年前的情报免费都会在其中一个被标记为袭击目标的地点看到“一所带运动场的学校”。

计算机科学家 Anh Totti Nguyen 研究了人工智能视觉系统出错的原因。他的论文《视觉语言模型是盲目的:无法将详细的视觉特征转化为词语》指出,当两个结构彼此靠近时,这些系统常常会出错,因为软件需要判断哪个是哪个。

《纽约时报》的卫星图像显示,沙贾拉·塔耶贝小学紧邻米纳布的一个伊朗伊斯兰革命卫队大院,这与阮的研究指出。

人工智能出错时,谁该负责?

前海军军官、安全与新兴技术中心高级研究员埃米莉亚·普罗巴斯科在“四重奏”播客节目,责任在于下达命令的指挥官。这就是军队的运作。她指出,所谓“黑箱问题”,即无法了解人工智能系统如何得出答案,是“一个仍在研究的领域,而非已经解决的问题”。

战前,Maven提供与国防部就两发生了合同:人工智能是否足够可靠,可以用于生死攸关的决策,以及使用人工智能连接分散的数据点是否会使其成为大规模监控工具trac

普罗巴斯科表示,这两个担忧都成立,但他指出“一家私营公司对军队如何开展行动”。

霍兰德·米歇尔说,讨论总是朝着最糟糕的情况发展:一台无需人为干预自动选择目标并开火的机器。他表示,这种风险确实存在,但这并非目前正在发生的。

他说: “更难、更紧迫的工作是让人工智能系统更加透明,并确保依赖其输出结果的人类能够做出真正知情的决定,而不是简单地听从机器的任何建议。”

人工智能生成的战争内容也在网络上迅速

BBC Verifytrac到人工智能制作的关于这场冲突的视频和篡改过的卫星图像,这些视频和图像吸引了数亿次的观看量。

昆士兰科技大学数字媒体研究员蒂莫西·格雷厄姆表示: “规模之大令人震惊,这场战争让我们再也无法忽视。 ” 他补充道: “过去需要专业视频制作才能完成的工作,现在只需几分钟就能借助人工智能工具完成。制作逼真的合成冲突画面的门槛已经基本消除。”

X公司表示,如果创作者发布未经标注的AI生成的战争视频,将会取消“是一个重要的信号,表明他们已经意识到这是一个严重的问题”。当被问及是否计划采取类似措施,Meta和TikTok均未作出回应。

你的钱在银行手里,你却只能拿到残羹剩饭。观看我们的免费视频,了解如何成为自己的银行