英特尔Xeon 6进驻英伟达DGX Rubin架构,股价为何暴涨7%后收跌?

英特尔Xeon 6处理器将作为英伟达DGX Rubin NVL8服务器的主CPU,标志着CPU在AI推理时代重归战略核心。此次合作延续了x86架构的协同基础,Xeon 6负责任务编排、内存管理和数据传输。尽管合作消息刺激英特尔股价一度上涨,但市场对其AI业务盈利前景仍持观望态度。分析认为,此举是英特尔在AI服务器领域的关键一步,亦印证了x86架构在AI生态中的价值,预示AI基础设施将走向CPU、GPU、DPU协同的异构架构。Xeon 6凭借高速内存支持、内存带宽提升、PCIe 5.0连接、优先核心睿频加速、Intel TDX安全技术及NVIDIA Dynamo框架支持,能有效解决AI推理场景中的数据供给瓶颈和性能调度需求。

TradingKey - 在2026年英伟达GTC大会上,英特尔(INTC)宣布其Xeon 6处理器将正式成为英伟达(NVDA)下一代旗舰AI服务器DGX Rubin NVL8的主CPU。

这一合作不仅延续了双方在Blackwell平台已建立的x86架构协同基础,更凸显着在AI工作负载从大规模训练向"无处不在的实时推理"转型的关键节点,CPU重新成为AI系统架构中的战略核心组件。

在英伟达DGX Rubin NVL8这套专为智能体AI和推理系统设计的旗舰服务器中,Xeon 6处理器承担着任务编排、内存管理、调度以及向GPU加速器传输数据的核心职责,成为连接算力与应用的关键桥梁。

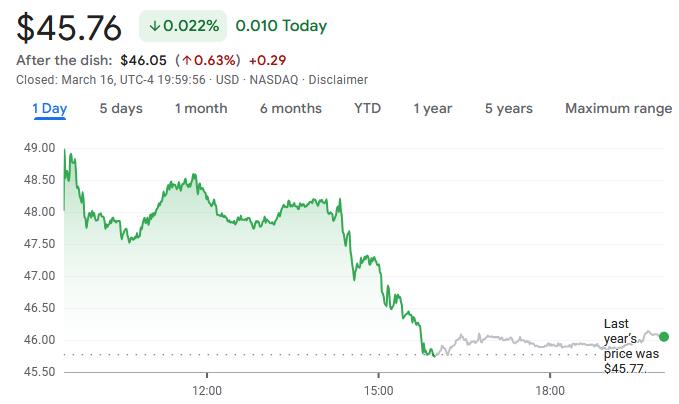

合作消息一出,一度刺激英特尔股价周一冲高7.4%,触及49.17美元的日高,但最终收盘微跌0.02%至45.76美元,成为当日费城半导体指数表现最差的成分股之一。

这种"先扬后抑"的走势,折射出市场对传统CPU厂商AI转型的矛盾心态——既认可英特尔与英伟达合作的战略意义,将其视为英特尔在AI服务器领域站稳脚跟的关键一步。但在GPU主导的AI算力市场中,投资者对英特尔AI业务的盈利前景仍持观望态度,需要更明确的盈利预期才能进一步提振信心。

不过研究机构Lynx Equity Strategies持积极态度,在分析报告中指出,此次英特尔Xeon 6进驻英伟达DGX Rubin NVL8系统,标志着两家公司的合作已经从技术概念走向了实际产品落地,未来可以从产品发布时间、潜在营收贡献等维度持续跟踪这一合作的商业价值。

CPU重回战略高地

从产业格局的角度看,英特尔与英伟达的此次合作,其意义已经远超单纯的零件供应关系。

对英特尔而言,这是一次精准的"战略防守",打破了"CPU在AI时代无关紧要"的行业偏见,证明在推理时代,CPU的调度、内存管理与安全特性是AI系统高效运行的必要支撑。

对整个AI产业而言,这印证了x86架构在AI生态中的深厚护城河,其庞大的安装基础与成熟软件生态,能有效降低企业AI转型的技术门槛与总体拥有成本。更重要的是,它预示着AI基础设施正在走向"架构再平衡",未来的AI系统将不再是GPU的独角戏,而可能是CPU、GPU、DPU多芯片协同的异构架构。

值得注意的是,此次英特尔Xeon 6进驻的是英伟达DGX Rubin NVL8机架系统,而非更大规模的NVL72机架,这延续了双方在Blackwell平台的合作逻辑——让Xeon处理器在基础8-GPU节点中担任主机处理器,负责数据预处理、模型载入、KV缓存管理与任务协调。

业界普遍认为,这只是双方合作的起点,随着AI推理需求的持续增长,未来Xeon处理器有望进一步整合进NVL72等超大规模机架系统。

英特尔Xeon 6的技术优势

英特尔方面表示,Xeon系列处理器能够成为DGX Rubin NVL8系统的核心CPU,核心在于其具备的多维度系统级优势,从硬件层面的高速内存支持、多场景工作负载下的性能均衡表现,到长期使用中的成本控制能力,再到经过市场验证的成熟企业级软件生态,

针对推理场景中日益增长的大模型KV缓存需求,Xeon 6所在的平台可支持高达8TB的系统内存,这一容量对于运行大型语言模型、存储关键键值数据至关重要。

同时,通过采用MRDIMM技术,Xeon 6实现了较上一代产品2.3倍的内存带宽提升,最高可达8800 MT/s,这一突破能显著提升数据传输到GPU加速器的速度,从根源上解决推理场景中常见的GPU数据供给瓶颈问题。

在系统连接性上,Xeon 6提供的PCIe 5.0通道可实现高带宽的加速器连接,确保多GPU集群间的数据流转效率。

而英特尔创新推出的"优先核心睿频加速"(Priority Core Turbo)功能,更是针对推理场景的复杂调度需求设计,它能将强劲的单线程性能集中用于编排、调度和数据传输任务,即便在多任务并行的复杂工作负载下,也能保证GPU维持高效运行状态。

安全性层面,Xeon 6处理器通过Intel信任域扩展(TDX)技术,为CPU到GPU的整个数据路径提供端到端的安全防护,其加密反弹缓冲区能增加基于硬件的隔离和认证功能,完美适配AI推理在数据中心、云端、边缘等多场景部署时的机密计算需求。

此外,Xeon 6还新增了对NVIDIA Dynamo推理编排框架的支持,借助这一框架,同一集群内的CPU和GPU资源可实现灵活的异构调度,进一步提升系统的整体运行效率。